Conoce a los razonadores RAP y LLM Dos marcos basados en conceptos similares para el razonamiento avanzado con LLMs

Razonadores RAP y LLM marcos para razonamiento avanzado con LLMs

Cada día que pasa trae un progreso notable en los Modelos de Lenguaje Grandes (LLMs), lo que lleva a herramientas y avances innovadores. Estos LLMs sobresalen en diversas tareas, incluyendo generación de texto, clasificación de sentimientos, clasificación de texto y clasificación sin etiquetas. Sus capacidades se extienden más allá de estas áreas, permitiendo la automatización de la creación de contenido, el servicio al cliente y el análisis de datos, revolucionando así la productividad y la eficiencia.

Recientemente, los investigadores también han comenzado a explorar el uso y la utilidad de los LLMs para el razonamiento. Estos modelos pueden comprender información textual compleja y sacar inferencias lógicas de ella. Los LLMs sobresalen en tareas como preguntas y respuestas, resolución de problemas y toma de decisiones. Sin embargo, los LLMs aún no pueden trabajar como los humanos, luchando con problemas que serían fáciles para los humanos, como generar planes de acción para ejecutar tareas en un entorno dado o realizar razonamientos matemáticos, lógicos y de sentido común complejos. Los LLMs tienen dificultades con ciertas tareas porque no tienen un modelo interno del mundo como lo tienen los humanos. Esto significa que no pueden predecir cómo serán las cosas en una situación dada o simular los resultados a largo plazo de las acciones. Los humanos poseen un modelo interno del mundo, una representación mental del entorno, que les permite simular acciones y sus efectos en el estado del mundo para una planificación deliberada durante tareas complejas.

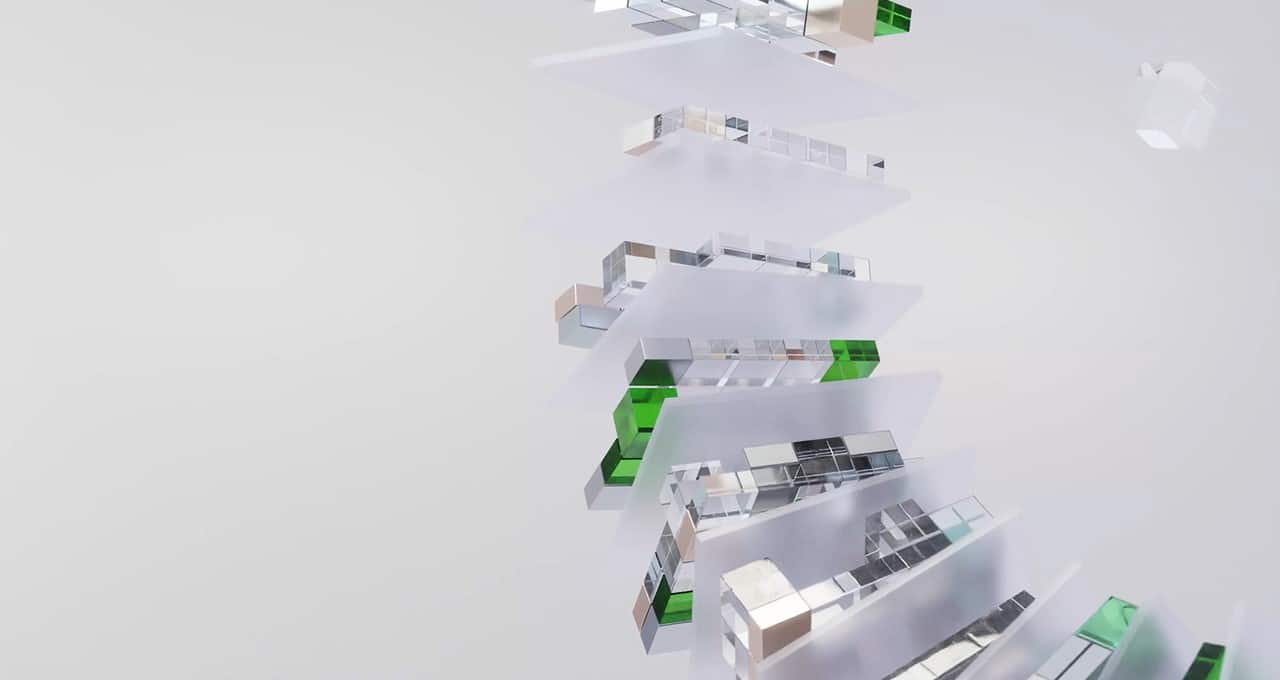

Para superar estos problemas, los investigadores han ideado un nuevo marco de razonamiento, Reasoning via Planning (RAP). Este marco utiliza una biblioteca que permite a los LLMs realizar razonamientos complejos utilizando algoritmos de razonamiento avanzados. Este marco aborda la metodología de razonamiento de múltiples pasos como planificación y busca la cadena de razonamiento óptima, que logra el mejor equilibrio entre exploración y explotación con la idea de “Modelo del Mundo” y “Recompensa”. Además del artículo RAP, el equipo de investigación también propone LLM Reasoners. LLM Reasoners es una biblioteca de IA diseñada para dotar a los Modelos de Lenguaje (LLMs) de la capacidad de llevar a cabo razonamientos intrincados mediante algoritmos avanzados. Percibe el razonamiento de múltiples pasos como planificación, busca la cadena de razonamiento más eficiente y optimiza el equilibrio entre exploración y explotación utilizando los conceptos de ‘Modelo del Mundo’ y ‘Recompensa’. Todo lo que necesitas hacer es definir una función de recompensa y, opcionalmente, un modelo del mundo. Los LLM Reasoners se encargan del resto, abarcando algoritmos de razonamiento, visualización, invocación de LLM y más.

- Keras 3.0 Todo lo que necesitas saber

- La IA y los implantes cerebrales restauran el movimiento y la sensación para un hombre paralizado

- Aceptando la IA para el Desarrollo de Software Estrategias de Solución e Implementación

Un modelo del mundo considera la solución parcial como el estado y simplemente agrega una nueva acción/pensamiento al estado como transición del estado. La función de recompensa es crucial para evaluar qué tan bien se desempeña un paso de razonamiento. La idea es que una cadena de razonamiento con una recompensa acumulada más alta es más probable que sea correcta.

Los investigadores realizaron una extensa investigación sobre este marco. Aplicaron RAP a varios problemas de razonamiento desafiantes en razonamiento matemático e inferencia lógica. Los resultados prácticos de estas tareas muestran que RAP supera a varios métodos de referencia sólidos. Cuando se aplica a LLaMA33B, RAP supera a CoT en GPT-4, logrando una impresionante mejora relativa del 33% en la generación de planes.

Durante el proceso de razonamiento, el LLM construye inteligentemente un árbol de razonamiento evaluando continuamente los mejores pasos de razonamiento posibles (acciones). Para hacer esto, utiliza su modelo del mundo, que es el mismo LLM utilizado de manera diferente. Al simular resultados futuros, el LLM estima recompensas potenciales y utiliza esta información para actualizar sus creencias sobre los pasos de razonamiento actuales. De esta manera, refina su razonamiento explorando mejores alternativas y mejorando sus decisiones. Este marco ofrece algoritmos de razonamiento de vanguardia, proporciona visualización e interpretación intuitivas y es compatible con cualquier otra biblioteca de LLM.

Los investigadores enfatizan que, después de realizar experimentos exhaustivos en diversos problemas de razonamiento desafiantes, se concluyó la superioridad de RAP sobre varios enfoques de razonamiento basados en CoT contemporáneos. El marco incluso se desempeñó mejor que GPT-4 avanzado en ciertos contextos. La flexibilidad de RAP en el diseño de recompensas, estados y acciones muestra su potencial como un marco versátil para abordar varias tareas de razonamiento. Es fascinante ver cómo RAP combina la planificación y el razonamiento de una manera innovadora. Este enfoque puede potencialmente revolucionar nuestra forma de abordar el razonamiento de los LLM, allanando el camino para que los sistemas de IA logren un pensamiento y una planificación estratégica a nivel humano.

We will continue to update Zepes; if you have any questions or suggestions, please contact us!

Was this article helpful?

93 out of 132 found this helpful

Related articles

- Top 40 Herramientas de IA Generativa 2023

- Investigadores de UC Berkeley presentan Nerfstudio un marco de trabajo en Python para el desarrollo de Neural Radiance Field (NeRF)

- Adopción empresarial de la IA generativa

- Nueva herramienta de imagen basada en HADAR te permite ver claramente en la oscuridad

- Este artículo de IA de China propone HQTrack un marco de IA para rastrear cualquier cosa de alta calidad en videos

- Ingeniería de Comandos Prácticos

- Descripción rápida y sencilla de los metadatos de un artículo de investigación