Python Causal Cinco Ideas Novedosas de Causalidad en NeurIPS 2023

Python Causal - Five Novel Causality Ideas at NeurIPS 2023

Nuevas ideas emocionantes que unen la causalidad con el modelado generativo, la predicción conformal y la topología.

NeurIPS es considerada una de las conferencias más importantes y prestigiosas sobre inteligencia artificial y aprendizaje automático a nivel mundial debido a su riguroso proceso de revisión de artículos y la alta calidad de la investigación aceptada.

Con su enfoque multidisciplinario, la conferencia abarca una amplia gama de temas relacionados con el desarrollo de sistemas inteligentes y algoritmos de aprendizaje automático.

El número de artículos relacionados con la causalidad aceptados en NeurIPS ha crecido exponencialmente en los últimos años.

En este artículo presentamos cinco artículos causales aceptados en la edición 2023 de la conferencia que llamaron mi atención por aportar nuevos y importantes conocimientos al campo.

- ¿Cómo afecta la anonimización de imágenes al rendimiento de la visión por computadora? Explorando técnicas de anonimización tradicionales vs. realistas

- Investigadores de China presentan un conjunto de datos de múltiples vistas a gran escala y del mundo real llamado ‘FreeMan

- Deci AI presenta DeciDiffusion 1.0 un modelo de difusión latente de texto a imagen de 820 millones de parámetros y 3 veces más rápido que la difusión estable.

Es importante tener en cuenta que esta es una lista subjetiva y ciertamente incompleta. Una de las razones de esto es que en el momento de escribir este artículo, NeurIPS aún no ha publicado la lista completa de artículos aceptados en la conferencia.

Dicho esto, estoy convencido de que las ideas presentadas en los artículos que se presentan a continuación tienen la oportunidad de llevar nuestro campo hacia adelante.

¡Comencemos!

Meta-aprendices conformes

La predicción conformal es una familia de técnicas de cuantificación de incertidumbre propuestas originalmente por Vladimir Vovk.

La predicción conformal no requiere un modelo (no se necesitan suposiciones de distribución) y proporciona garantías de cobertura frecuentista. En otras palabras, garantiza que el resultado real caerá dentro de los intervalos (o conjuntos) de predicción con alta probabilidad bajo la suposición de intercambiabilidad¹.

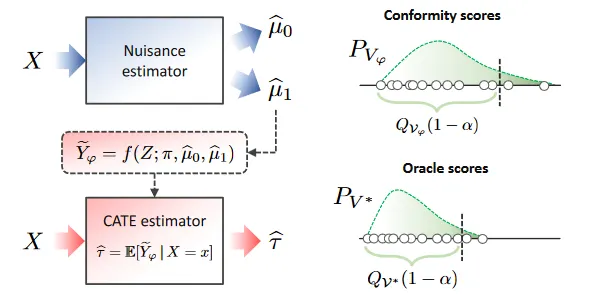

En su nuevo artículo Meta-aprendices conformes para la inferencia predictiva de los efectos individuales del tratamiento recién aceptado en NeurIPS 2022, Ahmed Alaa y sus colegas proponen un nuevo marco para los meta-aprendices conformes.

Su enfoque permite realizar inferencias directas sobre el parámetro objetivo (efecto individualizado del tratamiento; ITE), un…

We will continue to update Zepes; if you have any questions or suggestions, please contact us!

Was this article helpful?

93 out of 132 found this helpful

Related articles

- Investigadores de UCSD liberan Graphologue de código abierto una técnica única de IA que transforma las respuestas de modelos de lenguaje grandes como GPT-4 en diagramas interactivos en tiempo real.

- Hugging Face es el nuevo GitHub para LLMs

- Aprendizaje de Diferencia Temporal y la importancia de la exploración Una guía ilustrada

- 5 Mejores Certificaciones de Ciencia de Datos en Estados Unidos

- Investigación en Stanford presenta PointOdyssey un conjunto de datos sintético a gran escala para el seguimiento de puntos a largo plazo

- Google DeepMind presenta una nueva herramienta de IA que clasifica los efectos de 71 millones de mutaciones ‘missense

- 5 Proyectos Gratuitos de Ciencia de Datos con Soluciones