Conozca Prompt Diffusion Un marco de inteligencia artificial para permitir el aprendizaje en contexto en modelos generativos basados en difusión

Prompt Diffusion Un marco de IA para aprendizaje en contexto en modelos generativos basados en difusión

Los modelos de lenguaje grandes de última generación (LLMs), incluyendo BERT, GPT-2, BART, T5, GPT-3 y GPT-4, han sido desarrollados como resultado de los avances recientes en el aprendizaje automático, especialmente en el área de procesamiento del lenguaje natural (NLP). Estos modelos se han utilizado de manera efectiva para diversas tareas, incluyendo producción de texto, traducción automática, análisis de sentimientos y respuesta a preguntas. Su capacidad para aprender del contexto, conocida como aprendizaje en contexto, es uno de los comportamientos emergentes de estos LLMs. Sin optimizar ningún parámetro del modelo, los LLMs con capacidad de aprendizaje en contexto, como GPT-3, pueden completar una tarea condicionándose en muestras de entrada-salida y nuevas consultas de entrada.

La pre-entrenamiento de numerosas tareas de lenguaje puede combinarse con el aprendizaje en contexto y una estructura de instrucción bien diseñada, permitiendo que los LLMs generalicen de manera exitosa a actividades que nunca han encontrado. Aunque el aprendizaje en contexto ha sido ampliamente investigado en NLP, existen pocas aplicaciones en visión por computadora. Hay dos dificultades significativas para demostrar la practicidad y promesa del aprendizaje en contexto como una técnica estándar para las aplicaciones de gran visión: 1) Crear una instrucción efectiva en visión es más difícil que crear instrucciones para actividades de lenguaje porque requiere tanto pares de entrada-salida específicos del dominio como búsquedas de imágenes como criterios. 2) En visión por computadora, a menudo se entrenan modelos grandes para tareas especializadas, incluyendo generación de texto a imagen, creación condicional de clases, segmentación, detección y clasificación.

Estos modelos grandes de visión deben ser más flexibles para adaptarse a nuevas tareas y no están diseñados para el aprendizaje en contexto. Varios intentos recientes abordan estos problemas utilizando respuestas de NLP. Específicamente, cuando se crea una pista visual fundamental fusionando fotografías de muestra, imágenes de consulta e imágenes de salida en un solo embodiment masivo, se entrena un modelo de inpainting de imágenes basado en Transformer para anticipar las imágenes de salida enmascaradas. Sin embargo, la unión de fotos grandes aumentará significativamente los gastos computacionales, especialmente en escenarios de alta resolución. Este trabajo aborda el potencial de aprendizaje en contexto de modelos generativos basados en difusión guiados por texto al abordar estos dos problemas.

- ¿Pueden los LLM ejecutarse de forma nativa en tu iPhone? Conoce MLC-LLM un marco abierto que permite llevar los modelos de lenguaje (LLMs) directamente a una amplia clase de plataformas con aceleración de GPU.

- Conoce a TxGNN un nuevo modelo que utiliza el aprendizaje profundo geométrico y la inteligencia artificial centrada en el ser humano para hacer predicciones sin entrenamiento sobre el uso terapéutico en una amplia gama de 17,080 enfermedades.

- Cuidado con las sombras IA y patrones oscuros en nuestra vida digital

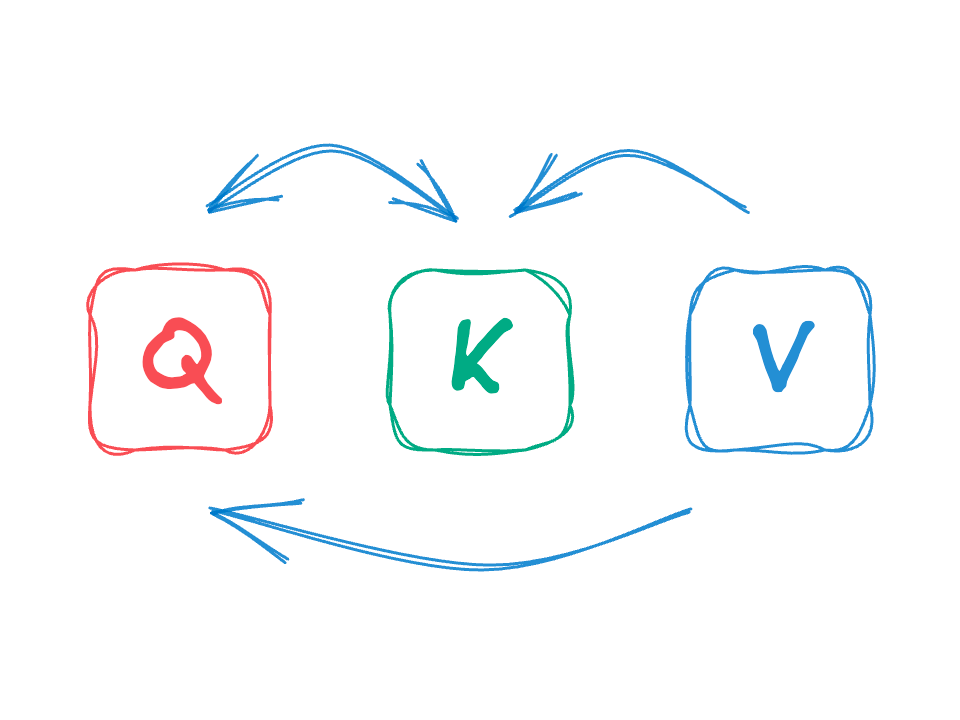

Para ejecutar el aprendizaje en contexto bajo una instrucción visión-lenguaje que pueda manejar una amplia gama de actividades visión-lenguaje, los investigadores de Microsoft y UT Austin presentan una nueva arquitectura de modelo llamada Difusión de Instrucción. La Difusión de Instrucción se somete a seis tareas visión-lenguaje separadas en conjunto. Específicamente, utilizan su instrucción visión-lenguaje para describir una tarea genérica visión-lenguaje. Luego, utilizando los diseños de Difusión Estable y ControlNet como inspiración, construyen la Difusión de Instrucción, que puede utilizar su instrucción visión-lenguaje como entrada. Sugieren la Difusión de Instrucción como un primer paso para habilitar la capacidad de los modelos de difusión guiados por texto para el aprendizaje en contexto. Luego puede utilizar este conocimiento para crear la imagen de salida remapeando la conexión en la imagen de consulta e incluyendo las instrucciones de lenguaje. Más crucialmente, el aprendizaje en varias tareas dota al modelo con la capacidad de aprendizaje en contexto. La Difusión de Instrucción puede generalizar de manera exitosa a varias funciones novedosas que aún no se han observado. Esto se suma a su buen rendimiento en las seis tareas que se han visto durante el entrenamiento.

Empíricamente, la Difusión de Instrucción tiene un buen desempeño en tareas familiares y novedosas no vistas en relación al aprendizaje en contexto. Se espera que la eficacia de la Difusión de Instrucción inspire y fomente más estudios sobre el aprendizaje visual en contexto basado en difusión. A continuación se presenta un resumen de sus principales contribuciones:

• Un diseño de vanguardia para instrucciones visión-lenguaje que permite efectivamente la fusión de múltiples actividades visión-lenguaje.

• Generación de alta calidad en contexto en las tareas aprendidas y nuevas que no se han visto utilizando el modelo de difusión de instrucciones, el primer modelo base adaptable visión-lenguaje basado en difusión capaz de aprendizaje en contexto.

• La implementación del código en Pytorch se puede encontrar en GitHub.

We will continue to update Zepes; if you have any questions or suggestions, please contact us!

Was this article helpful?

93 out of 132 found this helpful

Related articles

- Cómo realizar un seguimiento y visualizar experimentos de aprendizaje automático utilizando MLflow

- Gratis de Google Ruta de Aprendizaje de IA Generativa

- ¿En qué te has alimentado? Este modelo de IA puede extraer datos de entrenamiento de modelos de difusión

- Inteligencia Artificial Explicativa (IAE)

- Este artículo de IA propone un método novedoso basado en gradientes llamado Cones para analizar e identificar las neuronas conceptuales en modelos de difusión

- ¿Necesitas compresión?

- Cómo automatizar la calidad del código con los ganchos pre-commit de Python