Construyendo PCA desde cero

PCA desde cero

Potencia tu comprensión del Análisis de Componentes Principales con una derivación paso a paso

El Análisis de Componentes Principales (PCA) es una técnica antigua comúnmente utilizada para la reducción de dimensionalidad. A pesar de ser un tema conocido entre los científicos de datos, la derivación de PCA a menudo se pasa por alto, dejando valiosos conocimientos sobre la naturaleza de los datos y la relación entre el cálculo, la estadística y el álgebra lineal.

En este artículo, derivaremos PCA a través de un experimento mental, comenzando con dos dimensiones y extendiéndonos a dimensiones arbitrarias. A medida que progresemos en cada derivación, veremos la armoniosa interacción de ramas aparentemente distintas de las matemáticas, culminando en una elegante transformación de coordenadas. Esta derivación desentrañará la mecánica de PCA y revelará la fascinante interconexión de conceptos matemáticos. ¡Embarquémonos en esta iluminadora exploración de PCA y su belleza!

Calentando en dos dimensiones

Como seres humanos que vivimos en un mundo tridimensional, generalmente comprendemos conceptos bidimensionales, y aquí es donde comenzaremos en este artículo. Comenzar en dos dimensiones simplificará nuestro primer experimento mental y nos permitirá comprender mejor la naturaleza del problema.

Teoría

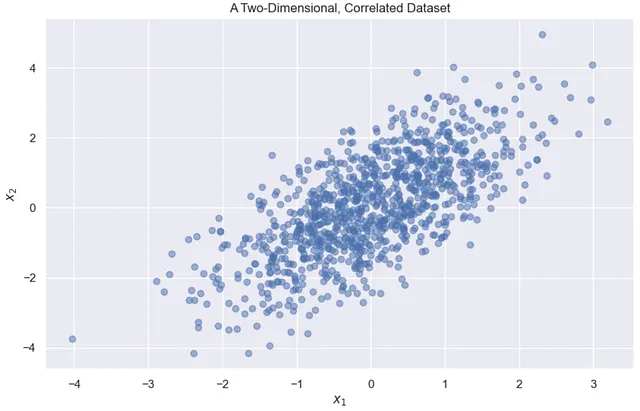

Tenemos un conjunto de datos que se parece algo a esto (ten en cuenta que cada característica debe estar escalada para tener una media de 0 y una varianza de 1):

- Cómo construir un pipeline de detección de cambios de datos completamente automatizado

- Fundamentos de Estadística para Científicos de Datos y Analistas

- Detectando Fraude en el Comercio Electrónico con Técnicas Avanzadas de Ciencia de Datos

Inmediatamente notamos que estos datos se sitúan en un sistema de coordenadas descrito por x1 y x2, y estas variables están correlacionadas. Nuestro objetivo es encontrar un nuevo sistema de coordenadas informado por la estructura de covarianza de los datos. En particular, el primer vector de base en el sistema de coordenadas debe explicar la mayoría de la varianza al proyectar los datos originales sobre él.

Nuestro primer paso es encontrar un vector tal que cuando proyectemos los datos originales sobre el vector, se preserve la máxima cantidad de varianza. En otras palabras, el vector ideal apunta en la dirección de máxima varianza, según lo definido por el…

We will continue to update Zepes; if you have any questions or suggestions, please contact us!

Was this article helpful?

93 out of 132 found this helpful

Related articles

- Inteligencia Artificial (IA) y Web3 ¿Cómo están conectados?

- Ami Hever, Co-Fundador y CEO de UVeye – Serie de Entrevistas

- Construyendo un Mapa Topográfico de Nepal Utilizando Python

- Expertos en tecnología comienzan a dudar de que las alucinaciones de ChatGPT, la IA, desaparezcan alguna vez

- El Cuadro de Búsqueda de Google Cambió el Significado de la Información

- 6 Diferentes formas en las que la IA podría ayudar a mejorar la experiencia del usuario

- El modelo de IA puede ayudar a determinar dónde se originó el cáncer de un paciente