Learn more about Search Results Replicar - Page 5

- You may be interested

- Qué sucederá si las pruebas de compatib...

- Destacar el texto mientras se está habl...

- La amistad con la modalidad única ha te...

- Aprendizaje automático para regresión c...

- Brave presenta a Leo un asistente de in...

- Conoce a BeLFusion Un enfoque de espaci...

- Plataforma moderna de MLOps para la Int...

- Construyendo y Desplegando Modelos de C...

- Proyecto de Ciencia de Datos de Predicc...

- Cómo el Aprendizaje Automático se conve...

- Inteligencia Artificial y las huelgas e...

- Investigadores de UC Berkeley presentan...

- Inflection-1 La Próxima Frontera de la ...

- Optimizar la preparación de datos con n...

- Europa avanza en la regulación de la IA...

Deblur AI de Google Afilado de tus imágenes

En nuestra era digital en constante evolución, donde capturar y compartir momentos a través de la fotografía se ha convertido en una parte integral…

Inteligencia Artificial vs. Inteligencia Humana Top 7 Diferencias

Introducción La inteligencia artificial ha recorrido un largo camino desde el personaje ficticio de IA JARVIS hasta el ChatGPT de la vida real. Sin…

Cómo *no* obtener modelos de aprendizaje automático en producción

Como científicos de datos, ingenieros de datos e ingenieros de ML, estamos bombardeados con información sobre modelos de ML en producción. Cientos de videos…

Portando el sistema de traducción fairseq wmt19 a transformers

Una publicación de invitado por Stas Bekman Este artículo es un intento de documentar cómo se trasladó el sistema de traducción fairseq wmt19 a…

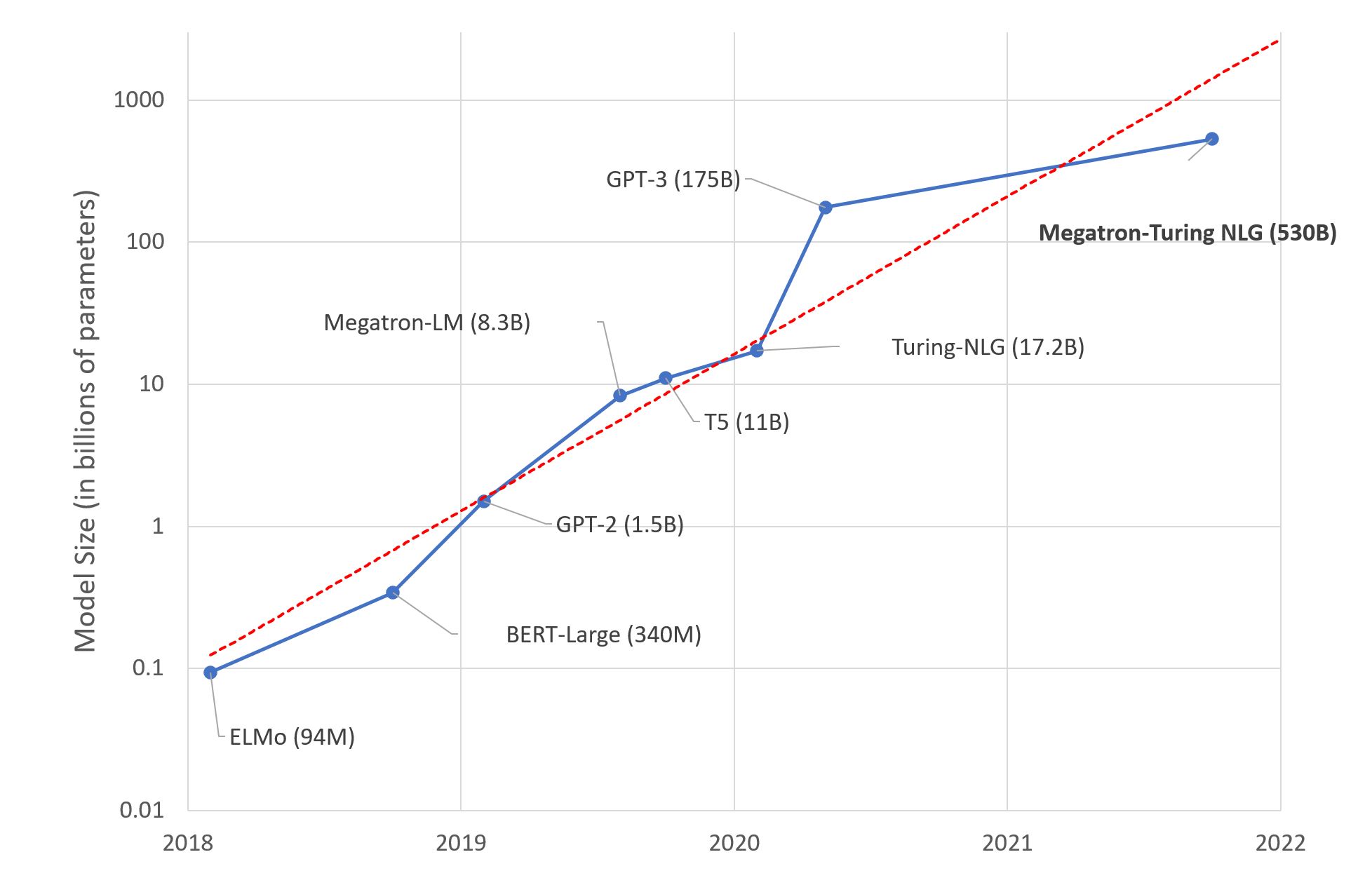

Modelos de Lenguaje Grandes ¿Una Nueva Ley de Moore?

Hace unos días, Microsoft y NVIDIA presentaron Megatron-Turing NLG 530B, un modelo basado en Transformers aclamado como “el modelo generativo de lenguaje más grande…

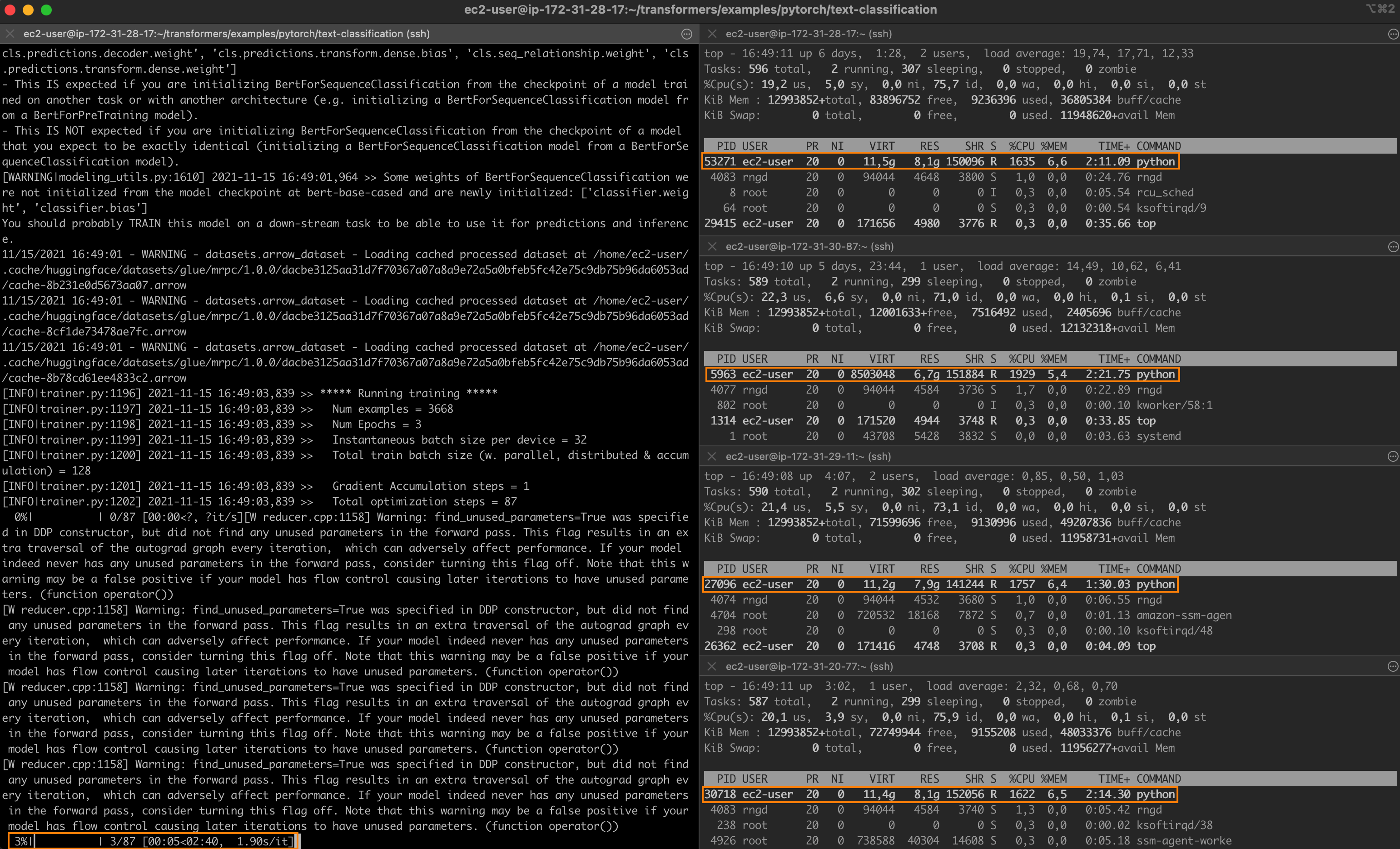

Acelerando el ajuste fino distribuido de PyTorch con tecnologías de Intel

Para toda su asombrosa capacidad, los modelos de aprendizaje profundo de última generación a menudo tardan mucho tiempo en entrenarse. Para acelerar los trabajos…

La Tecnología Detrás del Entrenamiento BLOOM

En los últimos años, se ha vuelto habitual entrenar modelos de lenguaje cada vez más grandes. Si bien se discute con frecuencia el tema…

🧨 ¡Difusión estable en JAX / Flax!

🤗 Hugging Face Diffusers soporta Flax desde la versión 0.5.1! Esto permite una inferencia súper rápida en las TPUs de Google, como las disponibles…

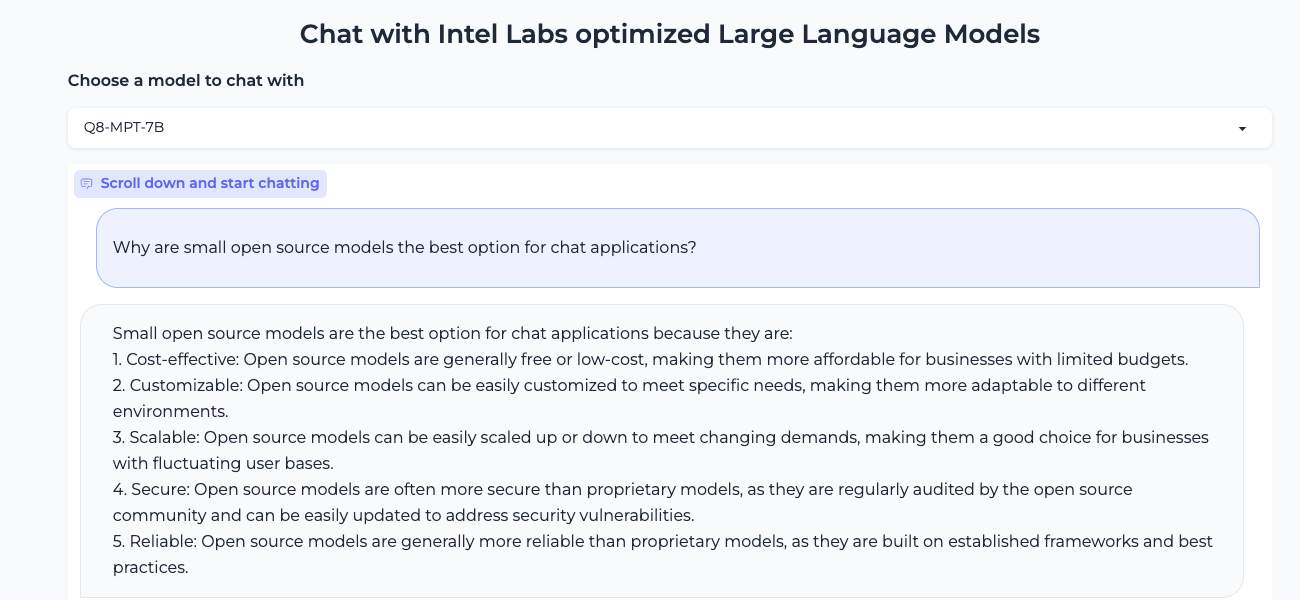

Más pequeño es mejor Q8-Chat, una experiencia eficiente de IA generativa en Xeon

Los modelos de lenguaje grandes (LLM) están revolucionando el mundo del aprendizaje automático. Gracias a su arquitectura Transformer, los LLM tienen una capacidad sorprendente…

¿Por qué el aprendizaje profundo siempre se realiza en datos de matriz? Nueva investigación de IA introduce ‘Spatial Functa’, donde desde los datos hasta la Functa se tratan como uno solo.

Las representaciones neurales implícitas (INRs) o campos neurales son redes neuronales basadas en coordenadas que representan un campo, como una escena en 3D, mapeando…

Trabajos que la IA no puede reemplazar

Introducción Ya seas un cibernauta o no, es probable que hayas escuchado el debate sobre los “empleos que la IA no puede reemplazar”. Aproximadamente…

Si la comunicación oral y escrita hizo que los seres humanos desarrollaran inteligencia… ¿Qué hay de los modelos de lenguaje?

La inteligencia humana, con sus extraordinarias capacidades cognitivas, se destaca sin igual entre otras especies. Los catalizadores detrás de esta supremacía intelectual se remontan…

La importancia de la reproducibilidad en el aprendizaje automático

Y cómo los enfoques para una mejor gestión de datos, control de versiones y seguimiento de experimentos pueden ayudar a construir tuberías de aprendizaje…

Más allá de la precisión Abrazando la serendipia y la novedad en recomendaciones para la retención a largo plazo del usuario.

Estás sentado en una cafetería, saboreando tu variante de café favorita (un cappuccino, por supuesto) y absorto en una conversación con un amigo. A…

¿Reemplazará la inteligencia artificial a los humanos?

Introducción Como todos sabemos, la inteligencia artificial ha dado grandes pasos adelante, cautivando la imaginación de científicos y el público en general. Las noticias…

PatchTST Un avance en la predicción de series temporales.

Los modelos basados en Transformer han sido aplicados con éxito en muchos campos, como el procesamiento del lenguaje natural (piense en los modelos BERT…

Flujos de trabajo CI/CD sin interrupciones con GitHub Actions en GCP sus herramientas para una eficaz MLOps.

Tutorial sobre cómo implementar un pipeline de aprendizaje automático y una aplicación web en GCP. Construya un pipeline CI/CD para automatizar la implementación utilizando…

FastAPI y Streamlit El dúo de Python que debes conocer.

Buckets de GCP/GCS. Backend de FastAPI que carga las predicciones. Construir un panel de predicciones y monitoreo utilizando Streamlit. Dockerizar todo.

LLM Apocalipsis Ahora La Venganza de los Clones de Código Abierto.

Esta es una historia acerca de cómo los proyectos de código abierto están desafiando a la industria de LLM.

Proyecto RedPajama Una iniciativa de código abierto para democratizar los modelos de lenguaje de aprendizaje automático (LLM)

Liderando el proyecto para Empoderar a la Comunidad a través de Modelos de Lenguaje Amplios Accesibles.

Find the right Blockchain Investment for you

Web 3.0 is coming, whether buy Coins, NFTs or just Coding, everyone can participate.