El equipo de Red AI de Google los hackers éticos que hacen que la IA sea más segura

Equipo de Red AI de Google hackers éticos que aseguran IA

El mes pasado, presentamos el marco AI seguro (SAIF), diseñado para ayudar a abordar los riesgos de los sistemas de IA y establecer estándares de seguridad para la tecnología de manera responsable.

Para aprovechar este impulso, hoy publicamos un nuevo informe para explorar una capacidad crítica que implementamos para respaldar SAIF: la simulación de ataques (red teaming). Creemos que la simulación de ataques desempeñará un papel decisivo en preparar a cada organización para ataques a los sistemas de IA y esperamos trabajar juntos para ayudar a todos a utilizar la IA de manera segura. El informe examina nuestro trabajo para establecer un equipo de simulación de ataques de IA dedicado e incluye tres áreas importantes: 1) qué es la simulación de ataques en el contexto de los sistemas de IA y por qué es importante; 2) qué tipos de ataques simulan los equipos de simulación de ataques de IA; y 3) lecciones que hemos aprendido y que podemos compartir con otros.

¿Qué es la simulación de ataques?

El Equipo de Simulación de Ataques de Google está compuesto por un equipo de hackers que simulan una variedad de adversarios, desde estados nacionales y grupos conocidos de Amenaza Persistente Avanzada (APT) hasta hacktivistas, delincuentes individuales e incluso empleados malintencionados. El término proviene del ámbito militar y describe actividades en las que un equipo designado juega un papel adversarial (el “Equipo Rojo”) contra el equipo local.

10:25

10:25

- Usando un Keras Tuner para la optimización de hiperparámetros de un modelo TensorFlow

- ¿Desvelando el poder de Meta’s Llama 2 ¿Un salto adelante en la IA generativa?

- GPT-Engineer Tu nuevo asistente de programación de IA

Para obtener más información sobre el Equipo de Simulación de Ataques de Seguridad de Google, mira el video de arriba.

En la última década, hemos evolucionado nuestra metodología para aplicar el concepto de simulación de ataques a las últimas innovaciones tecnológicas, incluida la IA. El Equipo de Simulación de Ataques de IA está estrechamente alineado con los equipos de simulación de ataques tradicionales, pero también cuenta con la experiencia necesaria en el tema de la IA para llevar a cabo ataques técnicos complejos en los sistemas de IA. Para asegurarnos de que están simulando actividades adversarias realistas, nuestro equipo aprovecha los últimos conocimientos de los equipos de Inteligencia de Amenazas de Google de clase mundial, como Mandiant y el Grupo de Análisis de Amenazas (TAG), la simulación de ataques por abuso de contenido en la confianza y la seguridad, e investigaciones sobre los últimos ataques de Google DeepMind.

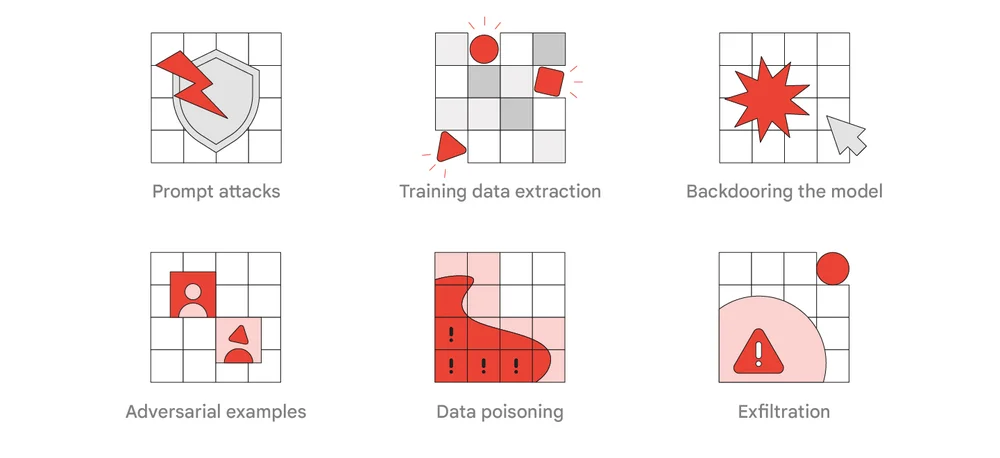

Tipos comunes de ataques de simulación de ataques en sistemas de IA

Una de las principales responsabilidades del Equipo de Simulación de Ataques de IA de Google es tomar investigaciones relevantes y adaptarlas para trabajar contra productos y características reales que utilizan IA para comprender su impacto. Los ejercicios pueden revelar hallazgos en seguridad, privacidad y disciplinas de abuso, según dónde y cómo se implemente la tecnología. Para identificar estas oportunidades para mejorar la seguridad, aprovechamos las tácticas, técnicas y procedimientos (TTP, por sus siglas en inglés) de los atacantes para probar una variedad de defensas del sistema. En el informe de hoy, hay una lista de TTP que consideramos más relevantes y realistas para adversarios del mundo real y ejercicios de simulación de ataques. Incluyen ataques rápidos, extracción de datos de entrenamiento, introducción de puertas traseras en el modelo, ejemplos adversarios, envenenamiento y extracción de datos.

Lecciones aprendidas

Ya hemos visto indicios tempranos de que las inversiones en experiencia y capacidades de IA en simulaciones adversarias tienen mucho éxito. Por ejemplo, las participaciones del equipo de simulación de ataques han resaltado vulnerabilidades y debilidades potenciales, lo que ha ayudado a anticipar algunos de los ataques que ahora vemos en los sistemas de IA. Estas son las lecciones clave que enumeramos en el informe:

- Los equipos de simulación de ataques tradicionales son un buen punto de partida, pero los ataques a los sistemas de IA se vuelven rápidamente complejos y se beneficiarán de la experiencia en el tema de la IA.

- Abordar los hallazgos del equipo de simulación de ataques puede ser un desafío y algunos ataques pueden no tener soluciones simples, por lo que alentamos a las organizaciones a incorporar la simulación de ataques en sus procesos de trabajo para impulsar la investigación y el desarrollo de productos.

- Los controles de seguridad tradicionales, como asegurarse de que los sistemas y modelos estén correctamente protegidos, pueden mitigar significativamente el riesgo.

- Muchos ataques a los sistemas de IA se pueden detectar de la misma manera que los ataques tradicionales.

Perspectivas futuras

Desde su creación hace más de una década, el Equipo de Simulación de Ataques de Google se ha adaptado a un panorama de amenazas en constante evolución y ha sido un socio confiable para los equipos de defensa en Google. Esperamos que este informe ayude a otras organizaciones a comprender cómo estamos utilizando este equipo crítico para asegurar los sistemas de IA y que sirva como un llamado a la acción para trabajar juntos en el avance de SAIF y elevar los estándares de seguridad para todos. Recomendamos que cada organización realice regularmente ejercicios de simulación de ataques para asegurar implementaciones críticas de IA en sistemas públicos importantes. Puedes obtener más información sobre la implementación de SAIF, la seguridad de los flujos de trabajo de IA y también puedes consultar mi charla de este año en el DEF CON AI Village.

We will continue to update Zepes; if you have any questions or suggestions, please contact us!

Was this article helpful?

93 out of 132 found this helpful

Related articles

- OmniSpeech se convierte en socio de software de audio de Cadence Tensilica para los algoritmos de voz de IA de próxima generación para satisfacer mejor a los clientes de automoción, móviles, consumo y IoT.

- UNESCO Expresa Preocupaciones Sobre la Implantación de Chips de IA en Relación a la Privacidad

- Investigadores del MIT y UC Berkeley presentaron un marco de trabajo que permite a los humanos enseñar rápidamente a un robot lo que quieren que haga con un esfuerzo mínimo.

- Microsoft AI propone MM-REACT un paradigma del sistema que combina ChatGPT y expertos en visión para un razonamiento y acción multimodal avanzados.

- Conoce Automated Reasoning And Tool-Use (ART) Un marco de trabajo que utiliza modelos de lenguaje grandes congelados (LLMs) para producir rápidamente etapas intermedias en programas de razonamiento.

- Ex CEO de Google empoderará al ejército de Estados Unidos con IA y el Metaverso

- Un nuevo marco de Aprendizaje por Reforzamiento Profundo (DRL) puede reaccionar ante atacantes en un entorno simulado y bloquear el 95% de los ciberataques antes de que se intensifiquen.