El primer IA visual y de lenguaje de propósito general LLaVA

El primer IA visual y de lenguaje LLaVA

LLaVA: Acortando la brecha entre la Inteligencia Artificial Visual y del Lenguaje con GPT-4

Originalmente publicado en louisbouchard.ai, ¡léelo 2 días antes en mi blog!

¡Mira el video!

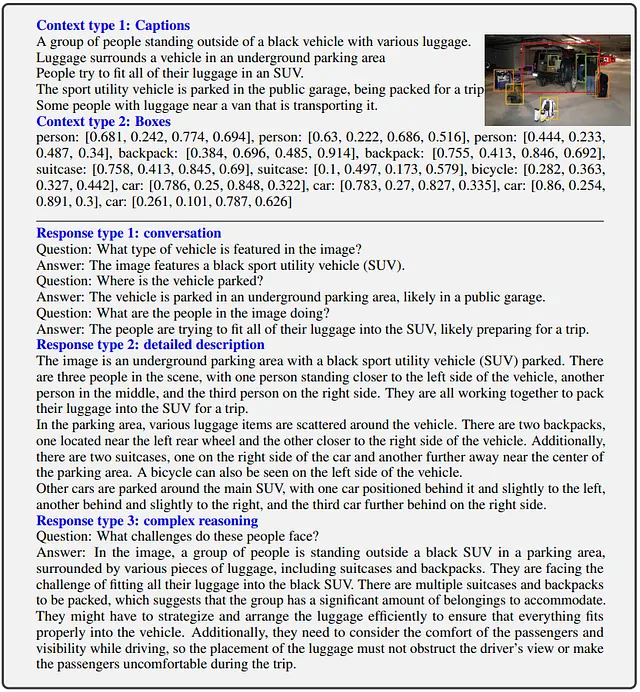

GPT-4 es poderoso, ¿pero sabías que algunos AIs se construyen completamente gracias a él? Sí, GPT-4 es tan bueno que se puede utilizar para generar datos lo suficientemente buenos como para entrenar otros modelos de IA. ¡Y no cualquier modelo, sino mejores modelos que él mismo! Liu et al. acaban de utilizar GPT-4 para crear un modelo de visión y lenguaje de propósito general llamado LLaVA, el primer modelo de propósito general que comprende y sigue instrucciones visuales y basadas en el lenguaje. Básicamente, es un modelo que tiene un entendimiento casi perfecto del texto y las imágenes al mismo tiempo. Por lo tanto, puedes preguntarle cualquier cosa sobre cualquier imagen. Dado que GPT-4 aún no puede ver imágenes, pero es increíblemente bueno con el texto, podemos enviarle los subtítulos de nuestra imagen y pedirle que produzca diferentes tipos de resultados, como preguntas para preguntas y respuestas, una descripción más detallada de la imagen o incluso preguntas y respuestas de razonamiento sobre el subtítulo de la imagen. Así es como lo hicieron los autores. Le dieron un papel y una personalidad al modelo GPT-4 y le pidieron que generara varios tipos de datos, todos basados en el subtítulo inicial que tenían para cada imagen.

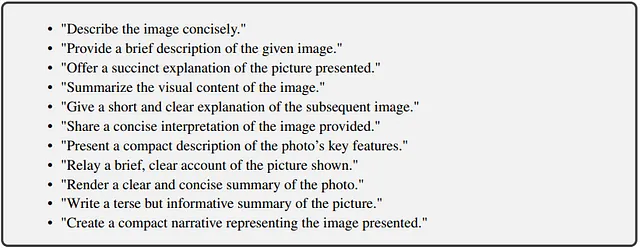

Así es cómo se veían las instrucciones dadas a GPT-4 en el caso de LLaVA para construir el mejor conjunto de datos posible que permitiera que el modelo de lenguaje comprendiera la imagen de la manera más profunda posible. Desde pedir una descripción concisa de la imagen hasta una descripción exhaustiva o incluso un análisis detallado de la misma.

Estas indicaciones generadas por el usuario y las respuestas generadas por GPT-4 poblarán un buen conjunto de datos lleno de diferentes preguntas, respuestas y descripciones de nuestras imágenes, lo que nos permitirá entrenar nuestra IA multimodal, es decir, una IA que puede procesar imágenes y texto para luego enviar…

- Más allá de los tutoriales Aprendiendo análisis de datos con el agente de Pandas de LangChain

- Investigadores de Inception, MBZUAI y Cerebras lanzan en código abierto ‘Jais’ el modelo de lenguaje árabe más avanzado del mundo

- ANPR con YOLOV8

We will continue to update Zepes; if you have any questions or suggestions, please contact us!

Was this article helpful?

93 out of 132 found this helpful

Related articles

- El Desvanecimiento Controlado

- Elegir la estrategia de GPU adecuada para tu proyecto de IA

- Comenzando con las Estructuras de Datos en Python en 5 pasos

- Conoce a AnomalyGPT Un nuevo enfoque de IAD basado en Modelos de Visión-Lenguaje de Gran Escala (LVLM) para detectar anomalías industriales

- El icónico escritor de terror Stephen King no teme a la IA

- Predicción de incertidumbre basada en entropía

- Introducción a Semantic Kernel para los entusiastas de Python