El equipo de IA de Microsoft presenta NaturalSpeech 2 un sistema TTS de vanguardia con modelos de difusión latente para una potente síntesis de voz sin necesidad de entrenamiento previo y prosodias expresivas mejoradas.

El equipo de IA de Microsoft lanza NaturalSpeech 2, un sistema TTS avanzado que ofrece una síntesis de voz potente sin entrenamiento previo y con mejoras en la prosodia.

El objetivo de la síntesis de voz (TTS, por sus siglas en inglés) es generar habla diversa y de alta calidad que suene como si lo hubieran pronunciado personas reales. Las prosodias, las identidades de los hablantes (como el género, el acento y el timbre), los estilos de habla y canto, y mucho más, contribuyen a la riqueza del habla humana. Los sistemas TTS han mejorado considerablemente en inteligibilidad y naturalidad a medida que las redes neuronales y el aprendizaje profundo han avanzado; algunos sistemas (como NaturalSpeech) incluso han alcanzado la calidad de voz a nivel humano en conjuntos de datos de referencia de grabación de estudio con un solo hablante.

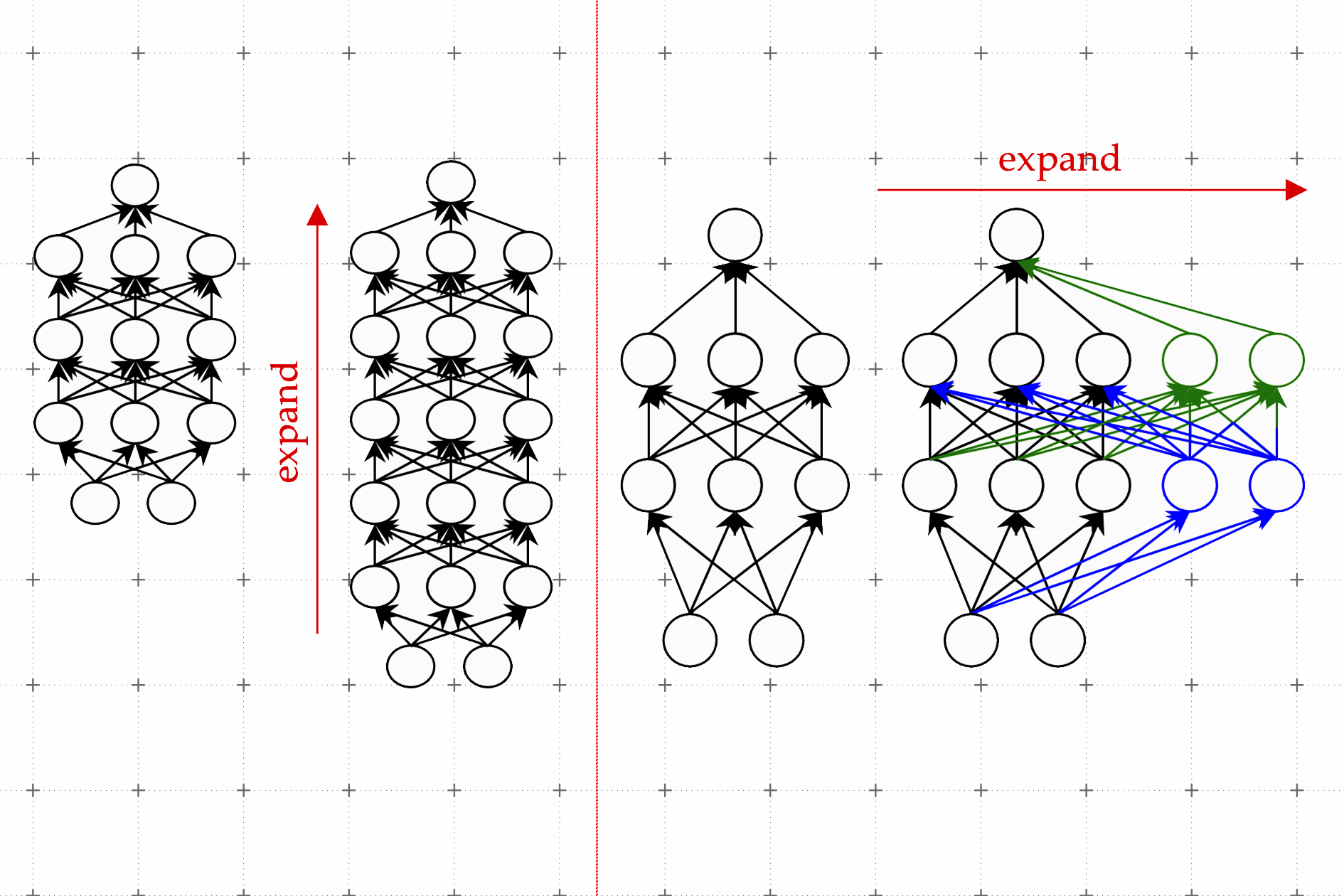

Debido a la falta de diversidad en los datos, los conjuntos de datos anteriores limitados a ciertos hablantes en estudios de grabación eran insuficientes para capturar la amplia variedad de identidades de hablantes, prosodias y estilos en el habla humana. Sin embargo, utilizando tecnologías de pocos o cero ejemplos, los modelos TTS pueden entrenarse en un corpus grande para aprender estas diferencias y luego utilizar estos modelos entrenados para generalizar a escenarios infinitos no vistos. Cuantificar la forma de onda continua del habla en tokens discretos y modelar estos tokens con modelos de lenguaje autoregresivos es común en los sistemas TTS a gran escala de hoy en día.

Una nueva investigación de Microsoft presenta NaturalSpeech 2, un sistema TTS que utiliza modelos de difusión latentes para producir prosodia expresiva, buena resistencia y, lo más importante, una gran capacidad de cero ejemplos para la síntesis de voz. Los investigadores comenzaron entrenando un códec de audio neural que utiliza un codificador de códec para transformar una forma de onda de habla en una serie de vectores latentes y un decodificador de códec para restaurar la forma de onda original. Después de obtener vectores previos de un codificador de fonemas, un predictor de duración y un predictor de tono, utilizan un modelo de difusión para construir estos vectores latentes.

- Generación rápida y precisa de hologramas acústicos utilizando un marco basado en aprendizaje profundo

- Este artículo de Inteligencia Artificial (IA) de Corea del Sur propone FFNeRV una nueva representación de video por cuadros utilizando mapas de flujo por cuadros y cuadrículas temporales de múltiple resolución

- Conoce a Rodin un nuevo marco de inteligencia artificial (IA) para generar avatares digitales en 3D a partir de diversas fuentes de entrada.

A continuación se presentan ejemplos de decisiones de diseño que se discuten en su artículo:

- En trabajos anteriores, el habla se cuantiza típicamente con numerosos cuantificadores residuales para garantizar la calidad de la reconstrucción del habla del códec neural. Esto sobrecarga mucho el modelo acústico (modelo de lenguaje autoregresivo) porque la secuencia resultante de tokens discretos es bastante larga. En lugar de usar tokens, el equipo utiliza vectores continuos. Por lo tanto, emplean vectores continuos en lugar de tokens discretos, lo que acorta la secuencia y proporciona más datos para una reconstrucción precisa del habla a nivel granular.

- Reemplazar modelos autoregresivos por modelos de difusión.

- Aprender en contexto a través de mecanismos de estímulo del habla. El equipo desarrolló mecanismos de estímulo del habla para fomentar el aprendizaje en contexto en el modelo de difusión y los predictores de tono/duración, mejorando la capacidad de cero ejemplos al alentar a los modelos de difusión a adherirse a las características del estímulo del habla.

- NaturalSpeech 2 es más confiable y estable que sus predecesores autoregresivos, ya que solo requiere un modelo acústico (el modelo de difusión) en lugar de la predicción de tokens en dos etapas. En otras palabras, puede utilizar su predicción de duración/tono y generación no autoregresiva para aplicarse a estilos distintos del habla (como una voz cantando).

Para demostrar la eficacia de estas arquitecturas, los investigadores entrenaron NaturalSpeech 2 con 400M de parámetros de modelo y 44K horas de datos de habla. Luego lo utilizaron para crear habla en escenarios de cero ejemplos (con solo unos segundos de estímulo de habla) con diversas identidades de hablantes, prosodias y estilos (por ejemplo, canto). Los resultados muestran que NaturalSpeech 2 supera a los sistemas TTS potentes anteriores en experimentos y genera habla natural en condiciones de cero ejemplos. Logra una prosodia más similar al estímulo de habla y al habla de referencia. También logra una naturalidad comparable o mejor (en términos de CMOS) que el habla de referencia en los conjuntos de prueba de LibriTTS y VCTK. Los resultados experimentales también muestran que puede generar voces cantando en un timbre novedoso con un breve estímulo de canto o, interesantemente, solo con un estímulo de habla, desbloqueando la síntesis de canto de cero ejemplos verdaderamente.

En el futuro, el equipo planea investigar métodos efectivos, como modelos de consistencia, para acelerar el modelo de difusión e investigar entrenamientos extendidos de voz hablada y cantada para permitir capacidades más potentes de mezcla de voz hablada y cantada.

We will continue to update Zepes; if you have any questions or suggestions, please contact us!

Was this article helpful?

93 out of 132 found this helpful

Related articles

- Los creativos están luchando contra la inteligencia artificial con demandas legales

- Potenciando la IA en Dispositivos Qualcomm y Meta colaboran con la tecnología Llama 2

- Microsoft lanza TypeChat una biblioteca de IA que facilita la creación de interfaces de lenguaje natural utilizando tipos.

- Las GPUs NVIDIA H100 ahora están disponibles en la nube de AWS

- El futuro de la guerra totalmente autónoma impulsado por IA está aquí

- Construye una estrategia exitosa de lanzamiento de productos con ChatGPT

- ¿Dónde están todas las mujeres?