¿Dónde están todas las mujeres?

¿Dónde están las mujeres?

Explorando los sesgos en el conocimiento histórico de los grandes modelos de lenguaje

Los grandes modelos de lenguaje (LLMs) como ChatGPT se utilizan cada vez más en entornos educativos y profesionales. Es importante comprender y estudiar los muchos sesgos presentes en dichos modelos antes de integrarlos en aplicaciones existentes y en nuestra vida diaria.

Uno de los sesgos que estudié en mi artículo anterior se refería a los eventos históricos. Investigé los LLMs para comprender qué conocimiento histórico codificaban en forma de eventos históricos importantes. Descubrí que codificaban un sesgo occidental serio hacia la comprensión de eventos históricos importantes.

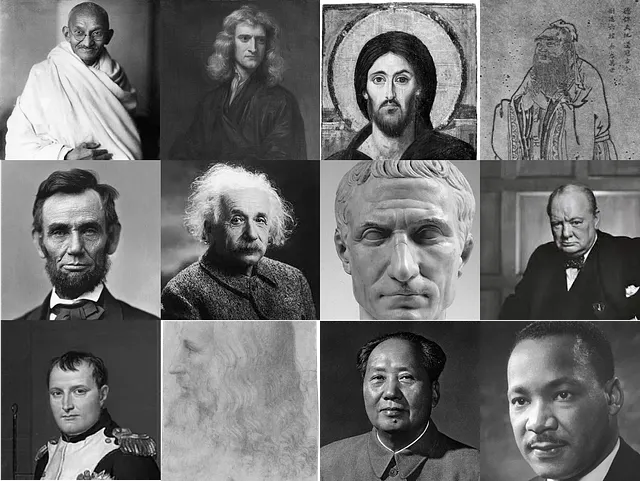

En la misma línea, en este artículo, investigo los modelos de lenguaje en cuanto a su comprensión de las figuras históricas importantes. Le pregunté a dos LLMs quiénes eran las personas históricas más importantes de la historia. Repetí este proceso 10 veces para 10 idiomas diferentes. Algunos nombres, como Gandhi y Jesús, aparecieron con mucha frecuencia. Otros nombres, como Marie Curie o Cleopatra, aparecieron con menos frecuencia. En comparación con la cantidad de nombres masculinos generados por los modelos, hubo muy pocos nombres femeninos.

La pregunta más importante que tenía era: ¿Dónde estaban todas las mujeres?

- Investigadores de UBC Canadá presentan un nuevo algoritmo de IA que mapea las rutas más seguras para los conductores en la ciudad

- Cómo navegar por el actual mercado laboral de la ciencia de datos

- El marco de trabajo de MLOps de 7 pasos de pila completa

Continuando con el tema de evaluar los sesgos históricos codificados por los modelos de lenguaje, investigué a GPT-4 de OpenAI y a Claude de Anthropic en cuanto a las figuras históricas importantes. En este artículo, muestro cómo ambos modelos contienen:

- Sesgo de género: Ambos modelos predijeron de manera desproporcionada figuras históricas masculinas. GPT-4 generó nombres de figuras históricas femeninas el 5.4% del tiempo y Claude lo hizo el 1.8% del tiempo. Este patrón se mantuvo en los 10 idiomas.

- Sesgo geográfico: Independientemente del idioma en el que se haya solicitado al modelo, hubo un sesgo hacia la predicción de figuras históricas occidentales. GPT-4 generó figuras históricas de Europa el 60% del tiempo y Claude lo hizo el 52% del tiempo.

- Sesgo de idioma: Ciertos idiomas sufrieron más sesgos de género o geográficos. Por ejemplo, cuando se solicitó en ruso, tanto GPT-4 como Claude no generaron mujeres en ninguno de mis experimentos. Además, la calidad del lenguaje fue menor en algunos idiomas. Por ejemplo, cuando se solicitó en árabe, los modelos tenían más probabilidades de responder incorrectamente generando…

We will continue to update Zepes; if you have any questions or suggestions, please contact us!

Was this article helpful?

93 out of 132 found this helpful

Related articles

- Estabilidad AI presenta Stable Diffusion XL 1.0

- AWS ofrece nuevas guías de inteligencia artificial, aprendizaje automático e IA generativa para planificar tu estrategia de IA

- Maximiza el rendimiento estable de la difusión y reduce los costos de inferencia con AWS Inferentia2

- Google en ICML 2023

- La función de detección de suplantación de identidad protege a las marcas y personalidades de las cuentas falsas en las redes sociales

- Cómo el hackeo de las abejas melíferas acerca la IA a la colmena

- Limpieza con TidyBot