Learn more about Search Results codificación de pares de bytes

- You may be interested

- Escala el entrenamiento y la inferencia...

- IA para desarrolladores web Introducció...

- Utilizando datos e inteligencia artific...

- Así es como puedes comenzar a usar Gemi...

- Optimizando el análisis de datos Integr...

- Desbloqueando el poder del difuminado f...

- Nuevo curso técnico de inmersión profun...

- Uso de Computadoras Analógicas en Intel...

- People Analytics es lo nuevo y grande, ...

- Candle y Falcon Una Guía para Modelos d...

- Top 40+ Herramientas Generativas de IA ...

- Una nueva investigación de IA introduce...

- Logrando una mayor coherencia interna e...

- Todo lo que necesitas para convertirte ...

- Conoce a Ego-Exo4D Un conjunto de datos...

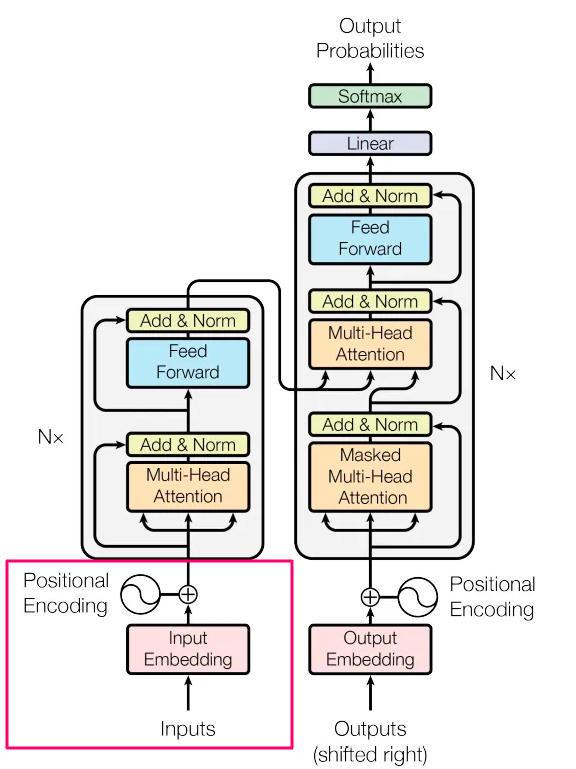

De-codificado Transformers explicados en un lenguaje sencillo

Sin código, matemáticas o mención de claves, consultas y valores.

¡Construye y juega! ¡Tu propio modelo V&L equipado con LLM!

Los modelos de lenguaje grandes (LLM) están demostrando cada vez más su valor. La incorporación de imágenes en los LLM los hace aún más…

¿Ahogado en datos? Un lago de datos puede ser su salvavidas

En el mundo digital de hoy, los datos son el rey. Las organizaciones que pueden capturar, almacenar, formatear y analizar datos y aplicar la…

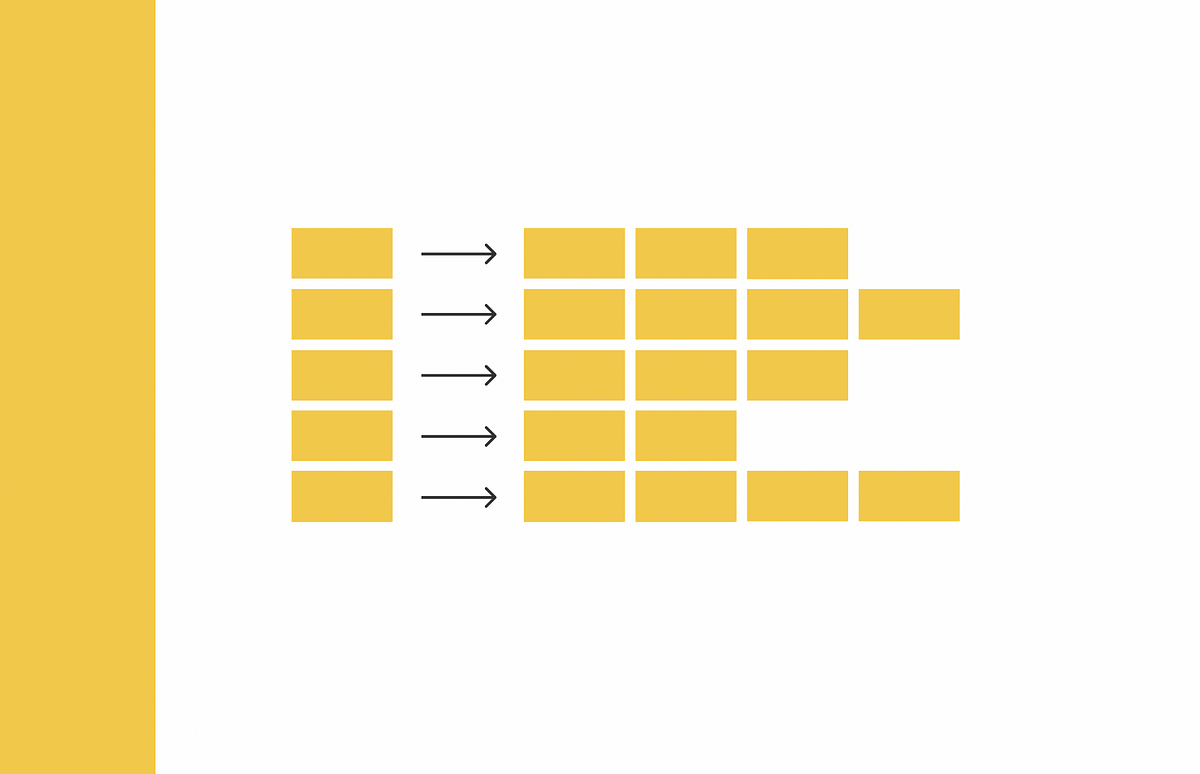

Simplificando Transformers NLP de última generación utilizando palabras que comprendes – parte 2 – Entrada

Dragón sale de huevos, los bebés saltan de vientres, el texto generado por IA comienza desde las entradas. Todos tenemos que empezar en algún…

Cómo entrenar un nuevo modelo de lenguaje desde cero utilizando Transformers y Tokenizers

En los últimos meses, hemos realizado varias mejoras en nuestras bibliotecas de transformers y tokenizers, con el objetivo de facilitar más que nunca el…

Portando el sistema de traducción fairseq wmt19 a transformers

Una publicación de invitado por Stas Bekman Este artículo es un intento de documentar cómo se trasladó el sistema de traducción fairseq wmt19 a…

Historia de optimización Inferencia de Bloom

Este artículo te brinda información sobre cómo creamos un servidor de inferencia eficiente que alimenta a bloom, un servidor de inferencia que alimenta https://huggingface.co/bigscience/bloom.…

Deduplicación a gran escala detrás de BigCode

Audiencia objetivo Personas interesadas en la deduplicación a nivel de documento a gran escala, y que tienen cierto entendimiento de hash, grafos y procesamiento…

Búsqueda de similitud, Parte 5 Hashing sensible a la localidad (LSH)

La búsqueda de similitud es un problema en el que, dada una consulta, el objetivo es encontrar los documentos más similares a ella entre…

Empezar con Google Cloud Platform en 5 pasos

Explora los fundamentos de Google Cloud Platform para la ciencia de datos y el aprendizaje automático, desde la configuración de la cuenta hasta la…

Optimizando tu LLM en producción

Nota: Esta publicación de blog también está disponible como una página de documentación en Transformers. Los Modelos de Lenguaje Grande (LLMs, por sus siglas…

Find the right Blockchain Investment for you

Web 3.0 is coming, whether buy Coins, NFTs or just Coding, everyone can participate.