Learn more about Search Results calibración

- You may be interested

- El próximo guardia de seguridad de tu e...

- ¿Qué es la fusión de modelos?

- Automatizando la Cadena del Pensamiento...

- Desde Guangzhou hasta Los Ángeles, los ...

- Las reseñas falsas son desenfrenadas en...

- IA generativa para series de tiempo

- Investigadores del MIT y de FAIR Meta r...

- Después de Twitter

- Unity anuncia el lanzamiento de Muse un...

- Productores de alimentos se unen frente...

- Miles en fila para obtener el implante ...

- Investigadores de UC Berkeley presentan...

- Herramientas de IA Médica pueden comete...

- Transforma tu proyecto de Ciencia de Da...

- Superpotencia el entrenamiento de tus m...

¿Podemos superar la fragilidad inmediata en los modelos de lenguaje grandes? La IA de Google presenta la calibración por lotes para un rendimiento mejorado.

Los modelos de lenguaje grandes han surgido recientemente como herramientas poderosas para diversas tareas de comprensión del lenguaje natural y clasificación de imágenes. Sin…

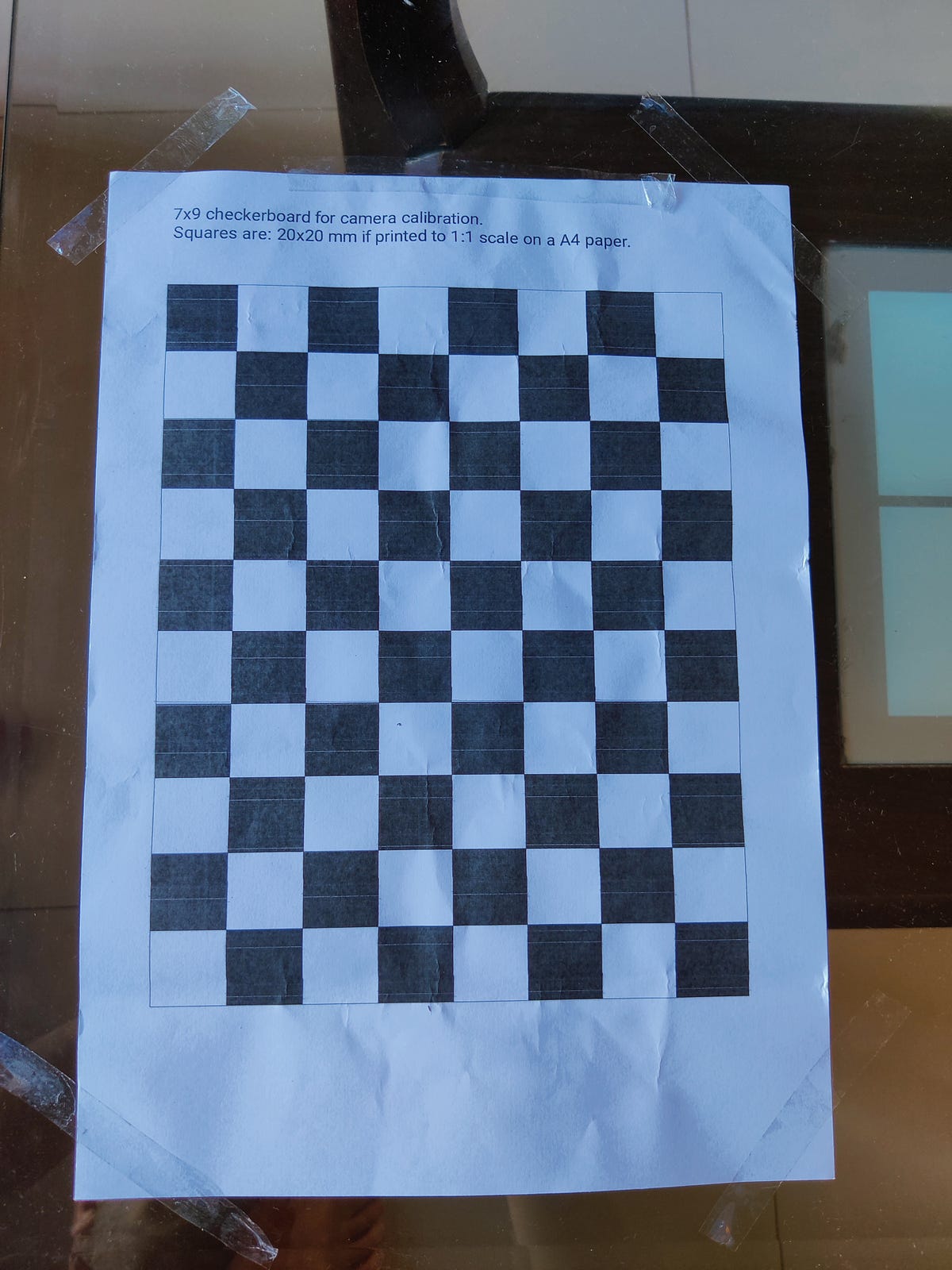

Calibración de cámara usando OpenCV

Una cámara es un dispositivo que convierte el mundo en 3D en una imagen en 2D. La cámara se categoriza a menudo en base…

Error de Calibración Esperado (ECE) – una explicación visual paso a paso

Una ejecución de la fórmula del Error de Calibración Esperado (ECE) en un ejemplo sencillo con 9 puntos de datos y código en Python…

Investigadores de Microsoft proponen un nuevo marco de trabajo para la calibración de LLM utilizando auto-supervisión óptima de Pareto sin utilizar datos de entrenamiento etiquetados.

Los recientes avances han visto un aumento notable en la capacidad de los grandes modelos de lenguaje (LLMs, por sus siglas en inglés), con…

Potenciando la fiabilidad del aprendizaje automático Cómo la atipicidad mejora el rendimiento del modelo y la cuantificación de la incertidumbre

Un objeto se considera típico si se asemeja a otros elementos de su categoría. Por ejemplo, un pingüino es un ave inusual, mientras que…

Investigadores de Microsoft Research y Georgia Tech revelan los límites estadísticos de las alucinaciones en los modelos de lenguaje

Un problema clave que ha surgido recientemente en los Modelos de Lenguaje es la alta tasa a la que proporcionan información errónea, incluyendo referencias…

Operacionalizar la evaluación de LLM a gran escala utilizando los servicios de Amazon SageMaker Clarify y MLOps

En los últimos años, los Modelos de Lenguaje Grande (LLMs) han cobrado importancia como herramientas excepcionales capaces de comprender, generar y manipular texto con…

La suite de referencia más grande de LLM MEGAVERSE

A medida que los LLM se vuelven más avanzados y más exhaustivos, los marcos de evaluación deben mantenerse al día con sus capacidades de…

Predicción Conformal para la Clasificación de Aprendizaje Automático Desde Cero

Esta publicación de blog está inspirada en el libro de Chris Molner Introducción a la Predicción Conformal con Python. Chris es brillante en hacer…

Cómo Amazon Music utiliza SageMaker con NVIDIA para optimizar el rendimiento y el costo del entrenamiento y la inferencia de machine learning.

En el dinámico mundo de la transmisión en Amazon Music, cada búsqueda de una canción, podcast o lista de reproducción guarda una historia, un…

ExLlamaV2 La biblioteca más rápida para ejecutar LLMs

ExLlamaV2 es una biblioteca diseñada para exprimir aún más rendimiento de GPTQ. Gracias a nuevos kernels, está optimizada para (increíblemente) rápidas inferencias.

Esta investigación de IA de China presenta Consistent4D Un nuevo enfoque de inteligencia artificial para generar objetos dinámicos en 4D a partir de videos monocu

El campo de la visión por computadora se enfrenta a una tarea fundamental pero ardua: descifrar datos tridimensionales dinámicos a partir de entradas visuales.…

Reduciendo y expandiendo Dominando la IA generativa con la cuantificación de modelos

Introducción En el siempre cambiante campo de la inteligencia artificial, la IA Generativa se ha convertido innegablemente en un pilar de la innovación. Estos…

Investigadores de Amazon presentan Fortuna una biblioteca de IA para la cuantificación de la incertidumbre en el aprendizaje profundo

Los recientes avances en los campos de Inteligencia Artificial y Aprendizaje Automático han hecho la vida más fácil para todos. Con sus increíbles capacidades,…

Reseña de HitPaw Photo Enhancer ¿El mejor Mejorador de Fotos de IA?

¿Quieres mejorar tus fotos con la tecnología de IA? Lee esta reseña de HitPaw Photo Enhancer para averiguar si vale la pena invertir.

Investigadores de CMU y NYU proponen LLMTime un método de inteligencia artificial para la predicción de series temporales de cero disparo con modelos de lenguaje grandes (LLMs)

A pesar de tener ciertos paralelos con otros problemas de modelado de secuencias, como texto, audio o video, las series de tiempo tienen dos…

Ramas son todo lo que necesitas nuestro marco de versionado de ML con opinión

Un enfoque simple para la versión de proyectos de ML utilizando ramas de Git que simplifica los flujos de trabajo, organiza datos y modelos,…

Este estudio de investigación de IA propone FireAct un nuevo enfoque de Inteligencia Artificial para el ajuste fino de modelos de lenguaje con trayectorias de múltiples tareas y métodos de agentes.

A menudo se pasa por alto el ajuste fino de los modelos de lenguaje para crear agentes de lenguaje, centrándose específicamente en mejorar sus…

En busca de la confianza de una modelo ¿Puedes confiar en una caja negra?

Este artículo explora estrategias para evaluar la confiabilidad de las etiquetas generadas por Modelos de Lenguaje Grandes (MLGs). Se discute la efectividad de diferentes…

Visión general de los esquemas de cuantización admitidos de forma nativa en 🤗 Transformers

Nuestro objetivo es brindar una descripción clara de los pros y los contras de cada esquema de cuantificación admitido en transformers para ayudarlo a…

Quantización GPTQ en un modelo Llama 2 7B Fine-Tuned con HuggingFace

En mi artículo anterior, te mostré cómo ajustar finamente el nuevo modelo Llama 2, recién lanzado por Meta AI, para construir un generador de…

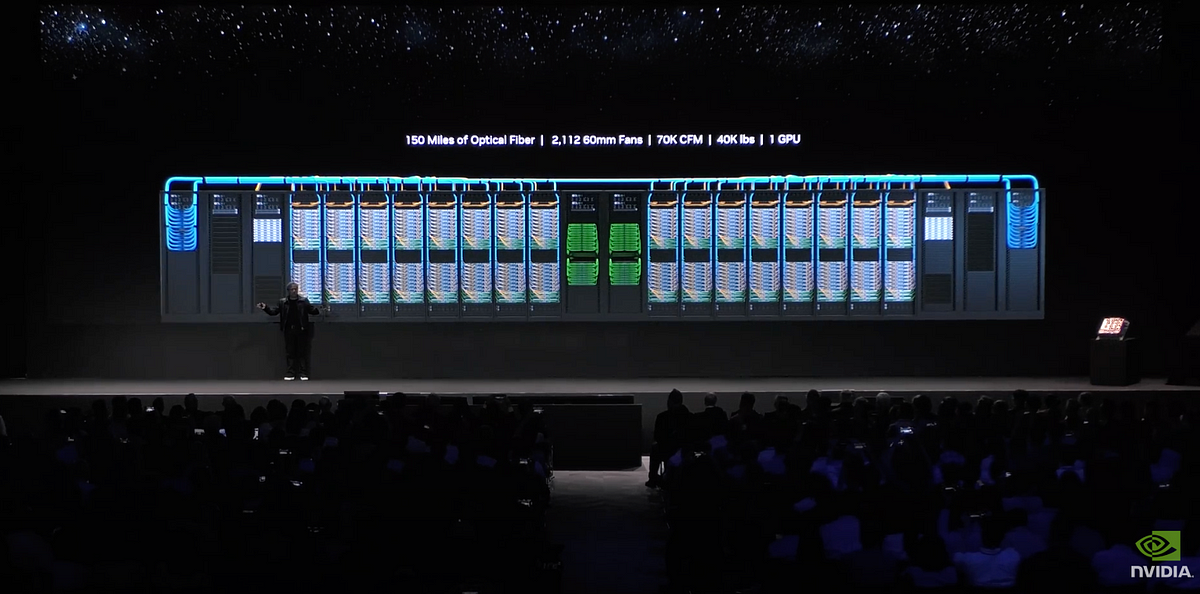

Fusión de imágenes de IA y DGX GH200

En el ámbito de la Visión por Computadora (CV), la capacidad de unir imágenes parciales y medir dimensiones no es solo un truco avanzado,…

MLOps para la inferencia por lotes con monitoreo y reentrenamiento del modelo utilizando Amazon SageMaker, HashiCorp Terraform y GitLab CI/CD

En esta publicación, describimos cómo crear un flujo de trabajo de MLOps para la inferencia por lotes que automatiza la programación de trabajos, el…

Haciendo LLMs más ligeros con AutoGPTQ y transformers

Los grandes modelos de lenguaje han demostrado capacidades notables en comprender y generar texto similar al humano, revolucionando aplicaciones en diversos campos. Sin embargo,…

¿Puede (Muy) Simple Matemáticas Informar RLHF Para Modelos de Lenguaje Grandes LLMs? ¡Este artículo de IA dice que sí!

Incorporar la entrada humana es un componente clave de las recientes mejoras impresionantes en las capacidades de los grandes modelos de lenguaje (LLM), como…

Find the right Blockchain Investment for you

Web 3.0 is coming, whether buy Coins, NFTs or just Coding, everyone can participate.