Learn more about Search Results GPTQ

- You may be interested

- Si solo tienes 3 minutos esta sugerenci...

- ¿Qué es la Inteligencia Artificial Estr...

- Descifrando oportunidades y desafíos pa...

- Aprende un idioma rápidamente con ChatG...

- ¿Pueden los Transformers aprender a est...

- Generación mejorada por recuperación (R...

- Guía para no ingenieros Entrena a un ch...

- 6 Comandos Mágicos para Jupyter Noteboo...

- La evolución de OpenAI Una carrera haci...

- Aprendizaje automático inspirado en Ind...

- Potenciando conocimientos sobre la Web ...

- Revisión del software de transcripción ...

- ¡Abrocha tu cinturón ¡El Falcon 180B es...

- GPT-4 8 Modelos en Uno; El Secreto ha S...

- 7 Pasos para Dominar las Técnicas de Li...

Quantización GPTQ en un modelo Llama 2 7B Fine-Tuned con HuggingFace

En mi artículo anterior, te mostré cómo ajustar finamente el nuevo modelo Llama 2, recién lanzado por Meta AI, para construir un generador de…

Haciendo LLMs más ligeros con AutoGPTQ y transformers

Los grandes modelos de lenguaje han demostrado capacidades notables en comprender y generar texto similar al humano, revolucionando aplicaciones en diversos campos. Sin embargo,…

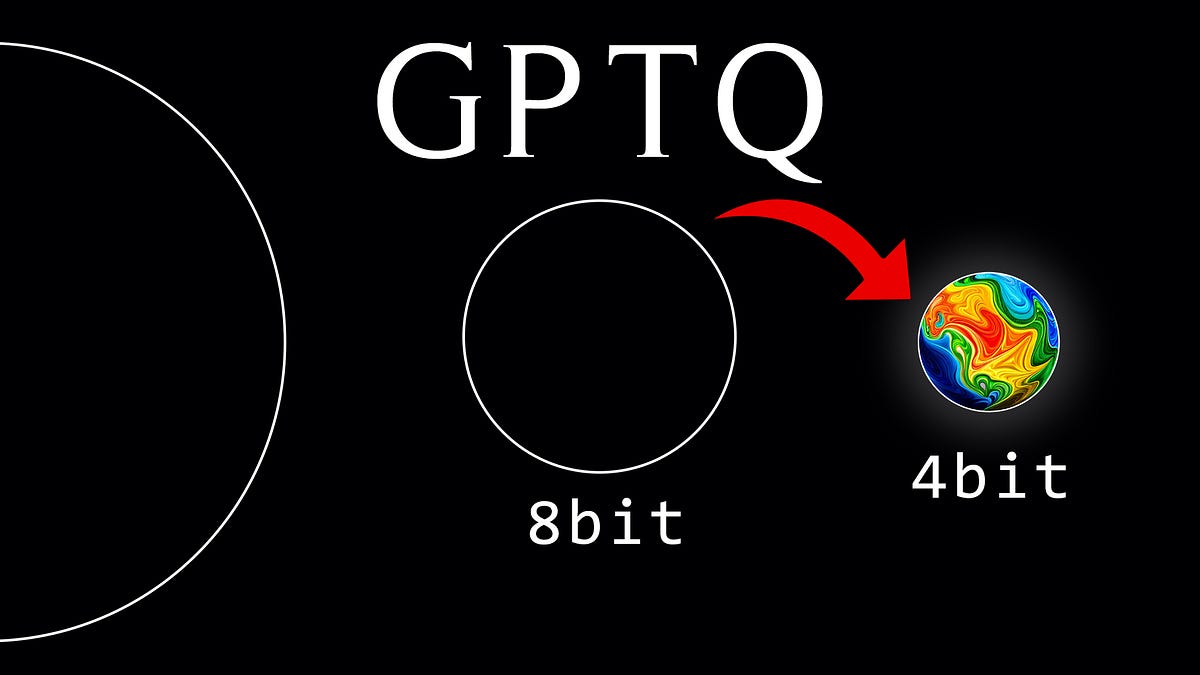

4-bit Cuantización con GPTQ

En este artículo, explicamos cómo el algoritmo GPTQ cuantiza eficientemente los pesos de LLM con una precisión de 4 bits e implementarlo utilizando AutoGPTQ.

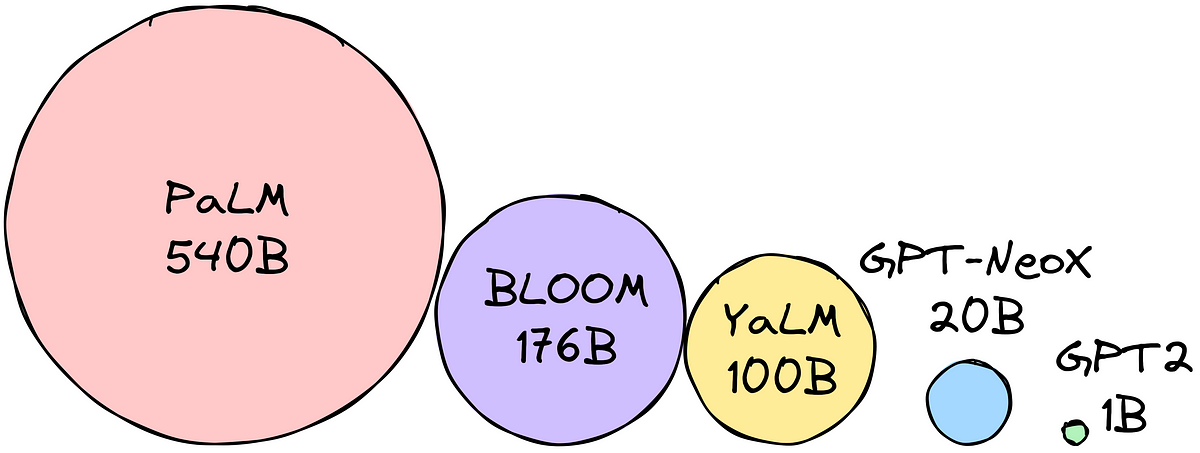

2023, año de los LLMs abiertos

2023 ha visto un aumento del interés público en los Modelos de Lenguaje Amplio (LLMs, por sus siglas en inglés), y ahora que la…

Explorando alternativas de código abierto a los modelos de OpenAI

Introducción Noviembre ha sido dramático en el espacio de la IA. Ha sido un viaje emocionante desde el lanzamiento de las tiendas GPT, GPT-4-turbo,…

Mejora el rendimiento de la inferencia para LLMs con los nuevos contenedores de Amazon SageMaker

Hoy, Amazon SageMaker lanza una nueva versión (0.25.0) de los Contenedores de Aprendizaje Profundo (DLC) para Inferencia de Modelos Grandes (LMI) y agrega soporte…

ExLlamaV2 La biblioteca más rápida para ejecutar LLMs

ExLlamaV2 es una biblioteca diseñada para exprimir aún más rendimiento de GPTQ. Gracias a nuevos kernels, está optimizada para (increíblemente) rápidas inferencias.

LangChain Cheatsheet – Todos los secretos en una sola página

El onepager creado es mi resumen de los conceptos básicos de LangChain. En este artículo, repasaré secciones de código y describiré el paquete inicial…

Creando un Agente LLAma 2 Empoderado con Conocimiento de Wikipedia

Los Modelos de Lenguaje Grandes (LLMs) son una de las tendencias más populares en IA. Han demostrado impresionantes capacidades de generación de texto, que…

Cómo ajustar modelos de lenguaje grandes en memoria pequeña cuantización

Los Modelos de Lenguaje Grandes se pueden utilizar para la generación de texto, la traducción, las tareas de pregunta-respuesta, etc. Sin embargo, los MLL…

Este boletín de IA es todo lo que necesitas #65

Esta semana en IA, tuvimos avances en la regulación de la IA desde el Capitolio líderes tecnológicos como Elon Musk y Mark Zuckerberg se…

Optimizando tu LLM en producción

Nota: Esta publicación de blog también está disponible como una página de documentación en Transformers. Los Modelos de Lenguaje Grande (LLMs, por sus siglas…

Visión general de los esquemas de cuantización admitidos de forma nativa en 🤗 Transformers

Nuestro objetivo es brindar una descripción clara de los pros y los contras de cada esquema de cuantificación admitido en transformers para ayudarlo a…

Extiende tus alas Falcon 180B está aquí

Introducción ¡Hoy estamos emocionados de dar la bienvenida al Falcon 180B de TII a HuggingFace! Falcon 180B establece un nuevo estado de la técnica…

¡Desbloquea el poder de GenAI LLMs directamente en tu máquina local!

Introducción Desde el lanzamiento de GenAI LLMs, hemos comenzado a utilizarlos de una forma u otra. La forma más común es a través de…

Este boletín de inteligencia artificial es todo lo que necesitas #62

Esta semana hemos estado observando el desarrollo de modelos de codificación en META, así como las nuevas capacidades de ajuste fino en OpenAI. Meta…

Desplegando Falcon-7B en Producción

Hasta ahora, hemos visto las capacidades de ChatGPT y lo que tiene para ofrecer. Sin embargo, para uso empresarial, modelos de código cerrado como…

Revolucionando la eficiencia de la IA El SqueezeLLM de UC Berkeley presenta la cuantificación densa y dispersa, uniendo la calidad y la velocidad en la entrega de modelos de lenguaje grandes.

Los recientes avances en los Modelos de Lenguaje Grande (LLM, por sus siglas en inglés) han demostrado su impresionante capacidad para resolver problemas en…

Find the right Blockchain Investment for you

Web 3.0 is coming, whether buy Coins, NFTs or just Coding, everyone can participate.