5 Herramientas para ayudar a construir tus aplicaciones de LLM

5 herramientas imprescindibles para construir aplicaciones de LLM

En la era de las aplicaciones avanzadas de modelos de lenguaje, los desarrolladores y científicos de datos están buscando continuamente herramientas eficientes para construir, implementar y gestionar sus proyectos. A medida que los modelos de lenguaje grandes (LLMs) como GPT-4 se hacen populares, cada vez más personas buscan aprovechar estos modelos poderosos en sus propias aplicaciones. Sin embargo, trabajar con LLMs puede ser complejo sin las herramientas adecuadas.

Por eso he reunido esta lista de cinco herramientas esenciales que pueden mejorar significativamente el desarrollo y la implementación de aplicaciones impulsadas por LLMs. Ya sea que estés empezando o seas un ingeniero de ML experimentado, estas herramientas te ayudarán a ser más productivo y a construir proyectos de LLM de mayor calidad.

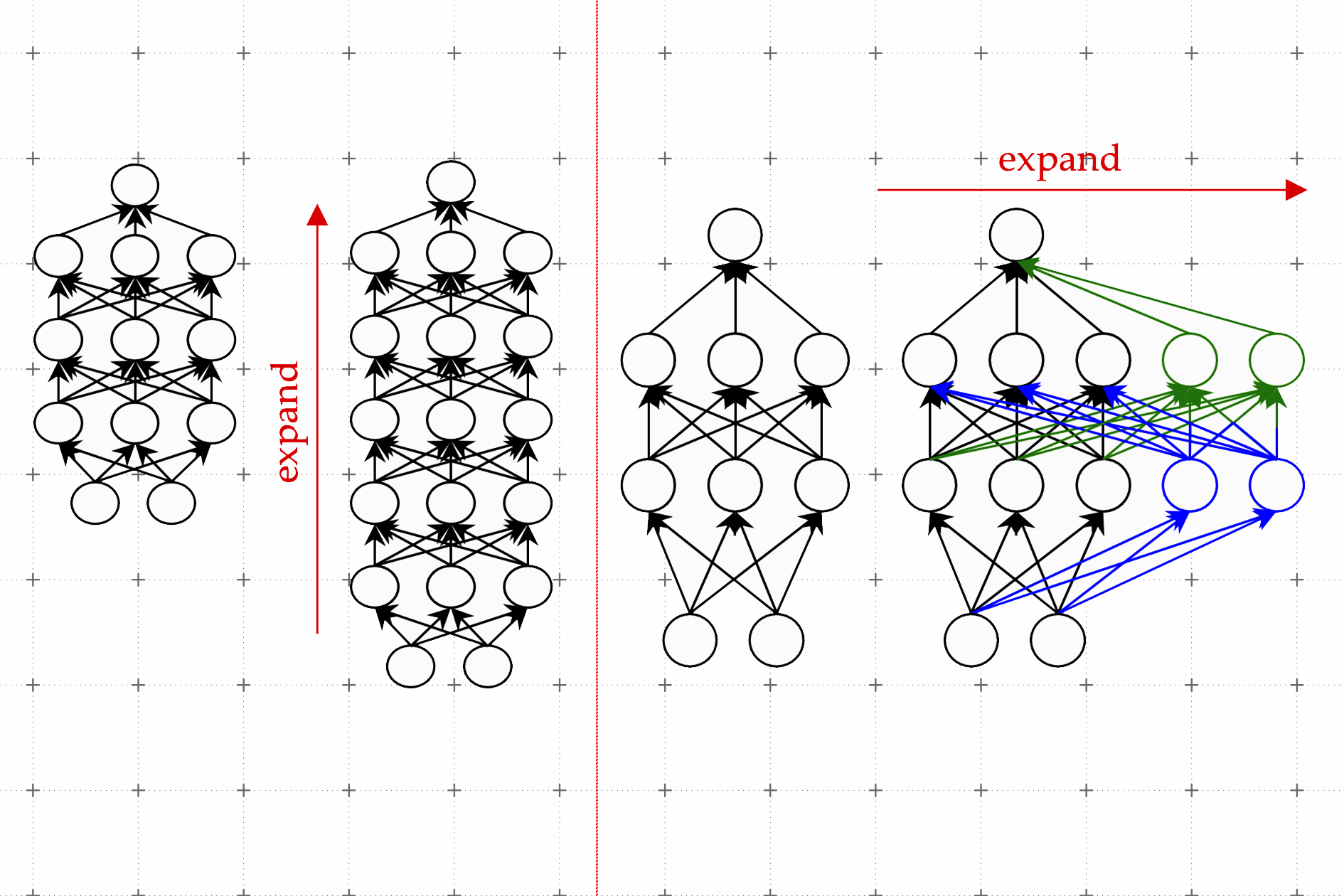

- Este artículo de IA presenta MVControl una arquitectura de red neuronal que revoluciona la generación de imágenes en múltiples vistas controlables y la creación de contenido en 3D.

- Estos modelos de aprendizaje profundo completamente automatizados se pueden utilizar para predecir el dolor utilizando la Escala de Rostro Felino (ERF) con integración de teléfonos inteligentes’.

- Revelando los entresijos Un análisis a fondo del mecanismo de atención de BERT

1. Hugging Face

Hugging Face es más que una plataforma de IA; es un ecosistema integral para alojar modelos, conjuntos de datos y demostraciones. Admite diversos frameworks que permiten a los usuarios entrenar, afinar, evaluar y generar contenido en varias formas como imágenes, texto y audio. La combinación de una amplia selección de modelos, recursos de la comunidad y APIs amigables para los desarrolladores en una sola plataforma es la razón por la cual Hugging Face se ha convertido en un destino clave para muchos profesionales de IA y ingenieros de ML.

Aprende cómo afinar el LLM Mistral AI 7B utilizando Hugging Face AutoTrain y enviar el modelo a Hugging Face Hub.

2. LangChain

LangChain es una herramienta que utiliza un enfoque de composición para construir aplicaciones con LLMs. Se utiliza ampliamente para desarrollar aplicaciones contextuales integrando diferentes fuentes de contexto con modelos de lenguaje. Además, puede utilizar un modelo de lenguaje para razonar sobre acciones o respuestas basadas en el contexto proporcionado. El equipo de LangChain AI ha introducido recientemente LangSmith, una nueva herramienta que proporciona una plataforma de desarrollo unificada para aumentar la velocidad y eficiencia de producción de aplicaciones de LLM.

Si eres nuevo en el desarrollo de IA, echa un vistazo a la hoja de referencia de LangChain para comprender la API de Python y otras funcionalidades.

3. Qdrant

Qdrant es un motor de búsqueda y base de datos de similitud de vectores basado en Rust que proporciona un servicio listo para producción con una API sencilla. Está diseñado para admitir filtrado extendido, por lo que es ideal para aplicaciones que utilizan coincidencia basada en redes neuronales o semántica. La velocidad y confiabilidad de Qdrant bajo alta carga lo convierten en una opción principal para convertir incrustaciones o codificadores de redes neuronales en aplicaciones completas para la búsqueda, recomendación y más. También puedes probar el servicio Qdrant Cloud totalmente gestionado, que incluye un nivel gratuito, para facilitar su uso.

Lee los 5 mejores bases de datos de vectores que debes probar en 2024 para conocer otras alternativas a Qdrant.

4. MLflow

MLflow ahora incluye soporte para LLMs, ofreciendo seguimiento de experimentos, evaluación y soluciones de implementación. Simplifica la integración de capacidades de LLM en aplicaciones mediante la introducción de características como el Servidor de Implementaciones de MLflow para LLMs, la Evaluación de LLM y la Interfaz de Ingeniería de Prompt. Estas herramientas ayudan a navegar por el complejo panorama de LLMs, comparando modelos fundamentales, proveedores y prompts para encontrar el mejor ajuste para tu proyecto.

Consulta la lista de 5 cursos gratuitos para dominar MLOps.

5. vLLM

vLLM es un motor de inferencia y servicio de alto rendimiento y eficiencia de memoria para LLMs. Conocido por su capacidad de servicio de última generación y una gestión eficiente de la memoria de clave y valor de atención, vLLM ofrece funciones como el procesamiento continuo por lotes, núcleos CUDA optimizados y compatibilidad con NVIDIA CUDA y AMD ROCm. Su flexibilidad y facilidad de uso, incluida la integración con modelos populares de Hugging Face y diversos algoritmos de decodificación, lo convierten en una herramienta valiosa para la inferencia y servicio de LLM.

Conclusión

Cada una de estas cinco herramientas aporta características únicas, ya sea en alojamiento, conciencia de contexto, capacidades de búsqueda, implementación o eficiencia en la inferencia. Al aprovechar estas herramientas, los desarrolladores y científicos de datos pueden optimizar significativamente sus flujos de trabajo y elevar la calidad de sus aplicaciones de LLM.

Obtén inspiración y crea 5 proyectos con modelos de IA generativa y herramientas de código abierto.

****[Abid Ali Awan](https://www.polywork.com/kingabzpro)**** (@1abidaliawan) es un profesional certificado en ciencia de datos que le encanta construir modelos de aprendizaje automático. Actualmente, se enfoca en la creación de contenido y la redacción de blogs técnicos sobre tecnologías de aprendizaje automático y ciencia de datos. Abid tiene un título de maestría en Gestión Tecnológica y un título de licenciatura en Ingeniería de Telecomunicaciones. Su visión es construir un producto de IA utilizando una red neural de grafos para ayudar a los estudiantes que luchan con enfermedades mentales.

We will continue to update Zepes; if you have any questions or suggestions, please contact us!

Was this article helpful?

93 out of 132 found this helpful

Related articles

- Los 10 mejores modelos de lenguaje grandes en Hugging Face

- Dominando la generación de datos sintéticos aplicaciones y mejores prácticas

- ¿Cómo las bases de datos vectoriales dan forma al futuro de las soluciones de IA generativa?

- Microsoft se une a sindicatos laborales estadounidenses para discutir sobre la fuerza laboral de IA

- Meta AI anuncia Purple Llama para ayudar a la comunidad a construir de manera ética con modelos de IA abiertos y generativos.

- Investigadores de Google DeepMind proponen Código de Cadena (CoC) una extensión simple pero sorprendentemente efectiva que mejora el razonamiento del Modelo de Lenguaje (LM) impulsado por código

- Enseñando a la IA a jugar juegos de mesa